LLM(大規模言語モデル)徹底解説!〜基本から応用まで〜

この記事は、LLM(大規模言語モデル)の基礎知識から仕組み、種類、生成AIとの関係までを解説しています。

さらに、実践的な活用事例や業界別成功事例、導入時の課題と選定基準、学習方法を網羅。

将来展望や効果的活用法まで含め、初心者から実務担当者まで役立つ総合ガイドです。

LLM(大規模言語モデル)は、ChatGPTをはじめとする生成AIの基盤技術として、2024年現在ビジネス界で最も注目されている技術の一つです。しかし、その仕組みや活用方法について正確に理解している方は多くありません。本記事では、LLMの基本概念から最新の技術動向、企業での実践的な活用事例まで、初心者から上級者まで理解できるよう体系的に解説します。LLMを理解し効果的に活用したい方は、ぜひ最後までご覧ください。

LLM(大規模言語モデル)とは?基本概念を徹底解説

LLMの定義と特徴

LLM(Large Language Models、大規模言語モデル)とは、膨大なテキストデータと高度なディープラーニング技術を用いて構築された自然言語処理モデルです。従来の言語モデルと比較して、「計算量」「データ量」「パラメータ数」という3つの要素を大幅に強化することで、人間のような自然な言語理解と生成を実現しています。

LLMの最大の特徴は、数十億から数兆個という膨大なパラメータを持つことです。例えば、GPT-3は1750億個、GPT-4は1兆個を超えるパラメータを持つとされています。この膨大なパラメータにより、複雑な言語パターンを学習し、文脈を理解した自然な文章生成が可能になります。また、ファインチューニングと呼ばれる手法により、特定のタスクに特化した性能向上も実現できます。

従来の言語モデルとの違い

従来の言語モデルは、単語の出現確率を統計的に分析する程度の機能しか持ちませんでした。しかし、LLMは深層学習技術により、文脈や意味を深く理解できます。従来モデルが「猫」という単語の後に「かわいい」が続く確率を計算するのに対し、LLMは文章全体の文脈を理解して、より適切で自然な表現を生成します。

また、従来モデルでは人間によるラベル付けが必要でしたが、LLMは大量の未ラベルテキストから自動的に言語パターンを学習できます。これにより、多様な言語タスクに対応できる汎用性を獲得し、テキスト分類、感情分析、文章要約、質問応答など幅広い用途で活用可能になりました。処理速度も大幅に向上し、リアルタイムでの対話も実現しています。

LLMが注目される理由と背景

LLMが急速に注目を集める背景には、2022年のChatGPT登場による社会的インパクトがあります。わずか2か月で1億ユーザーを突破し、AIの可能性を一般社会に広く示しました。企業においても、業務効率化や新しいビジネスモデル創出のツールとして急速に普及しています。

技術的な進歩も注目の理由です。2017年に発表されたTransformerアーキテクチャにより、長距離の文脈理解が可能になり、2024年現在では音声や画像も理解するマルチモーダルAIへと発展しています。さらに、計算コストの削減や推論速度の向上により、実用的なビジネス活用が現実的になったことも大きな要因です。日本語特化モデルの開発も進み、日本企業での導入障壁も下がっています。

LLMの仕組みと技術的構造を詳しく解説

トークン化とデータ前処理

トークン化とデータ前処理

LLMの処理は、まず入力テキストのトークン化から始まります。トークン化とは、文章を最小の意味単位に分割する処理で、コンピュータが理解しやすい形式に変換します。日本語の場合、「こんにちは」という単語が「こん」「にち」「は」のように分割されることもあれば、単語全体が一つのトークンとして扱われることもあります。

現代のLLMでは、サブワードトークン化が主流です。これは単語をより小さな部分文字列に分割する手法で、未知の単語や造語にも対応できる利点があります。例えば、「unbelievable」が「un-」「believe」「-able」に分割されることで、モデルは語幹と接辞の関係を学習し、類似の構造を持つ新しい単語も理解できるようになります。Byte-Pair EncodingやSentencePieceなどの手法が代表的です。

エンコードとベクトル化

トークン化されたデータは、次に数値ベクトルに変換されます。この過程をエンコードと呼びます。各トークンは高次元のベクトル(通常数百から数千次元)として表現され、単語の意味や関係性が数値的に捉えられます。これにより、「王」-「男」+「女」=「女王」のような意味的な計算が可能になります。

エンコード処理では、単語の文脈的な意味も考慮されます。同じ「バット」という単語でも、野球の文脈では運動用具として、動物の文脈ではコウモリとして異なるベクトル表現になります。この文脈理解により、LLMは人間のような柔軟な言語理解を実現しています。Word2VecやBERTなどの技術により、意味的類似性を持つ単語は近い位置のベクトル空間に配置されます。

Transformerアーキテクチャの仕組み

現代LLMの中核技術であるTransformerアーキテクチャは、2017年に発表された革新的な技術です。従来の循環型ニューラルネットワーク(RNN)とは異なり、文章全体を並列処理できるため、大幅な処理速度向上を実現しました。また、長距離の文脈依存関係も効率的に学習できます。

Transformerの核心は「Attention機構」です。これは文章内の各単語が他のすべての単語とどの程度関連しているかを計算する仕組みです。例えば、「彼は犬を散歩させた」という文では、「彼」が「散歩させた」の主語であることを正確に把握できます。Self-AttentionとCross-Attentionにより、入力と出力の複雑な対応関係を学習し、高精度な言語生成を実現しています。エンコーダーとデコーダーの組み合わせにより、様々な言語タスクに対応できる汎用性も獲得しています。

デコードと出力生成プロセス

最終段階のデコードでは、内部ベクトル表現を人間が理解できるテキストに変換します。このプロセスでは、各時点で次に来る単語の確率分布を計算し、最も適切な単語を選択します。ソフトマックス関数により、候補となる全ての単語に対して0から1の間の確率が割り当てられます。

実際の文章生成では、単純に最高確率の単語を選ぶのではなく、ランダム性も考慮します。Temperature samplingやTop-k samplingなどの手法により、自然で多様な文章生成が可能になります。また、ビームサーチという手法では、複数の候補を同時に検討することで、より一貫性のある長文生成を実現します。これらの技術により、LLMは人間のような創造的で自然な文章を生成できるのです。

2024年注目のLLMの種類と最新モデル比較

OpenAI GPTシリーズ(GPT-4o、o1)

OpenAI GPTシリーズ(GPT-4o、o1)

OpenAIのGPTシリーズは、2024年現在最も注目されるLLMの一つです。2024年5月に発表されたGPT-4o(omni)は、テキスト、画像、音声を統合処理できるマルチモーダルモデルとして画期的な進歩を遂げました。従来のGPT-4と比較して処理速度が2倍向上し、リアルタイム対話性能も大幅に強化されています。

2024年9月に登場したo1シリーズは、推論能力に特化した革新的なモデルです。複雑な数学問題や科学的分析において、従来モデルを大きく上回る性能を示しています。特に「思考プロセス」を明示的に表示する機能により、AIの判断根拠を理解できるようになりました。12月にはo1 pro modeも提供開始され、さらに高精度な推論が可能になっています。料金体系も従来の従量課金から月額制オプションが追加され、企業での導入しやすさが向上しています。

Google Geminiシリーズ

Googleが開発するGeminiシリーズは、検索エンジンとの統合が大きな特徴です。2024年12月にリリースされたGemini 2.0 Flash Thinkingは、先代モデルの2倍の処理速度と高い精度を実現し、特にコーディングや数学的問題解決に強みを持っています。回答時に思考過程を生成することで、より高度な推論も可能になりました。

Geminiの強みは、Google検索やGoogle Workspaceとのシームレスな連携です。最新情報へのアクセスが容易で、ビジネス文書の作成から分析まで、実務での活用価値が高いモデルです。また、多言語対応も優秀で、日本語での性能も継続的に向上しています。Google Cloud Platformでの提供により、企業での大規模運用にも適しています。料金面でも競争力があり、中小企業での導入が進んでいます。

Meta Llamaシリーズと日本語特化LLM

Meta社が開発するLlamaシリーズは、オープンソースモデルとして注目を集めています。2024年9月のLlama 3.2では、モバイル利用向けの軽量テキストモデル(1B、3B)と、画像理解に優れたビジョンモデル(11B、90B)が提供されています。商用利用も可能で、企業が独自にカスタマイズできる柔軟性が評価されています。

日本語特化LLMとしては、リコーが開発した130億パラメータモデルが注目されています。2024年1月時点で日本語LLMの最高性能を記録し、日本企業の業務での活用に最適化されています。ELYZAやサイバーエージェントなど、日本企業による独自LLM開発も活発化しており、日本語の文法や文化的文脈を深く理解したモデルが次々と登場しています。これらのモデルは、日本特有のビジネス文書や敬語表現に対応できる点で、海外製モデルにない価値を提供しています。

企業向けカスタムLLMの動向

2024年は企業独自のカスタムLLM開発が加速した年でもあります。KDDIとELYZAの提携によるコンタクトセンター特化型LLMアプリケーション「Altius ONE for Support」は、業務効率化とサービス品質向上を同時に実現した成功事例として注目されています。明治安田生命では、年間約55万件の作業時間を30%削減する成果を上げています。

企業向けカスタムLLMの利点は、業界固有の専門用語や業務プロセスに特化できることです。金融、医療、製造業など各分野で専門性の高いモデルが開発されており、汎用モデルでは難しい高精度な業務支援が可能になっています。また、データのプライバシー保護やセキュリティ要件も満たしやすく、機密性の高い業務での活用が進んでいます。初期投資は必要ですが、長期的なROIの観点から導入を検討する企業が増加しています。

LLMと生成AI・ChatGPTの違いと関係性

LLM、生成AI、ChatGPTの概念整理

LLM、生成AI、ChatGPTの概念整理

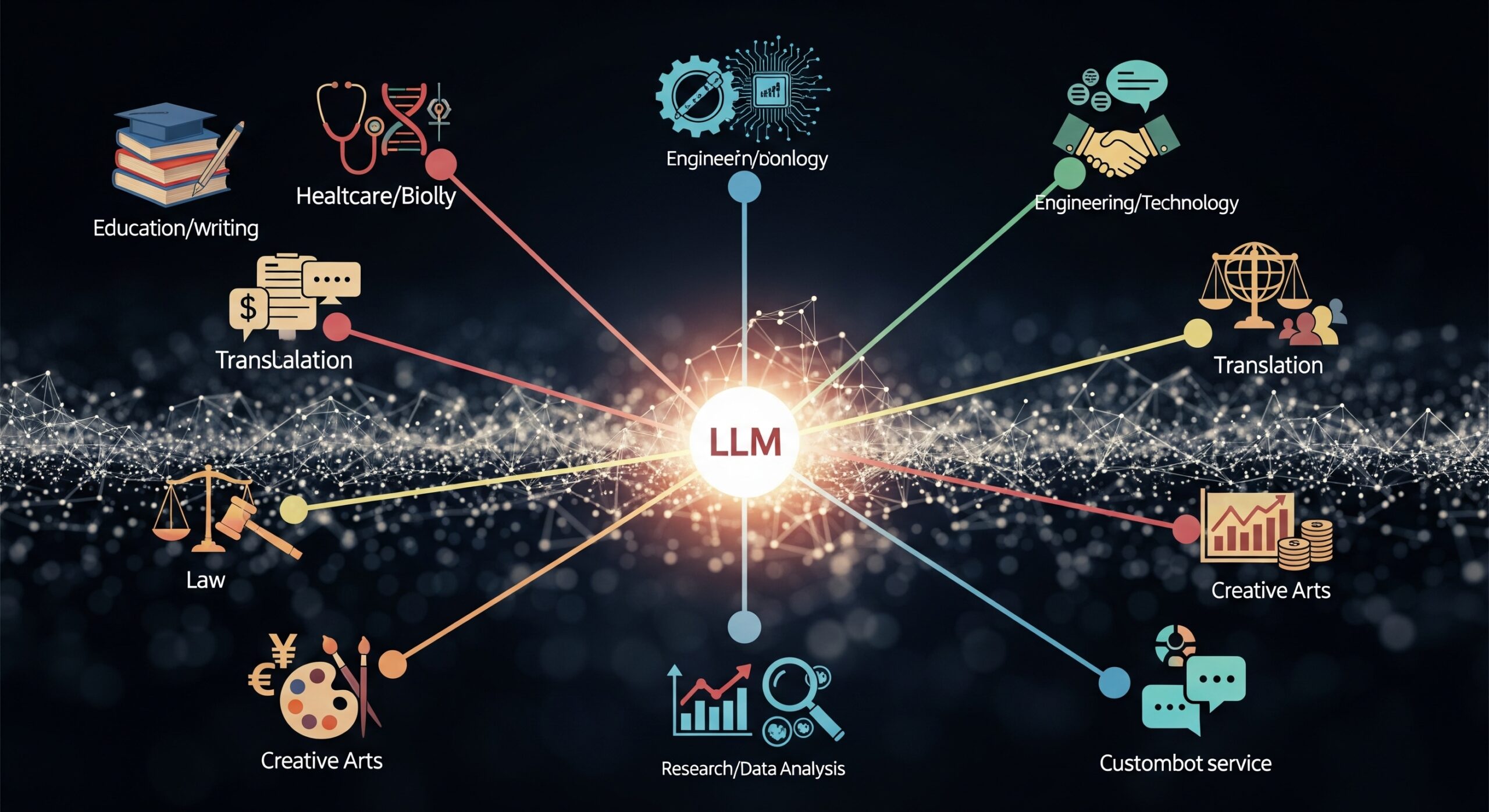

LLM、生成AI、ChatGPTの関係性を正確に理解することは、AI技術を効果的に活用するために重要です。生成AIは新しいコンテンツを自動生成できるAI技術の総称で、テキスト、画像、音声、動画など多様なメディアを扱えます。LLMは生成AIの一種で、特にテキスト生成に特化した言語モデルです。ChatGPTは、LLMを基盤として対話に最適化されたサービスの名称です。

具体的には、生成AIの中にLLMが含まれ、LLMの応用例としてChatGPTが存在するという階層構造になっています。生成AIには他にも、画像生成のMidjourney、音楽生成のSuno AI、動画生成のRunway MLなどがあります。LLMの代表例には、GPT-4、BERT、Gemini、Llamaなどがあり、それぞれ異なる特徴と用途を持っています。この概念の整理により、適切な技術選択が可能になります。

技術的な違いと特徴比較

技術的観点から見ると、LLMは言語理解と生成に特化しており、テキストデータで訓練されます。一方、生成AIは多様なデータ形式に対応し、各メディアに適した異なるアーキテクチャを使用します。LLMは主にTransformerアーキテクチャを基盤としていますが、画像生成AIはGAN(Generative Adversarial Networks)やDiffusion Modelを使用することが多いです。

処理能力の面では、LLMは文脈理解と論理的思考に優れ、長文の読解や複雑な推論を得意とします。画像生成AIは視覚的創造性に特化し、音楽生成AIは聴覚的な美的感覚を持ちます。LLMの強みは、ファインチューニングにより特定のタスクに高度に適応できることです。また、プロンプトエンジニアリングにより、同一モデルで多様な用途に対応できる汎用性も持っています。学習データの量と質がLLMの性能に大きく影響するため、継続的な改善が重要です。

活用場面による使い分け

実際のビジネス活用では、目的と要件に応じた適切な選択が重要です。文書作成、要約、翻訳、質問応答などのテキスト処理にはLLMが最適です。マーケティング資料の作成、ブログ記事の執筆、カスタマーサポートの自動化などで威力を発揮します。一方、プレゼンテーション用の図表作成、商品画像の生成、ブランドロゴのデザインには画像生成AIが適しています。

統合的な活用も効果的です。LLMで企画書のテキストを作成し、画像生成AIでビジュアル要素を追加することで、完成度の高い資料を効率的に作成できます。ChatGPTのようなサービスは、複数のAI技術を組み合わせており、テキスト生成から画像解析まで一つのインターフェースで利用できる利便性があります。コスト面では、汎用サービスは初期投資が少なく、専用モデルは長期的にコストパフォーマンスが優れる傾向があります。用途と予算を総合的に考慮した選択が成功の鍵です。

LLMのビジネス活用事例と導入メリット

カスタマーサポートと問い合わせ対応

カスタマーサポートと問い合わせ対応

LLMを活用したカスタマーサポートは、24時間365日対応を実現し、顧客満足度向上と運用コスト削減を同時に達成しています。従来のルールベースチャットボットと比較して、LLMは自然な会話でより複雑な問い合わせにも対応できます。KDDIの事例では、コンタクトセンター特化型LLMにより、一次対応の自動化率が大幅に向上し、オペレーターはより複雑な案件に集中できるようになりました。

効果的な実装には、FAQデータの整備と継続的な学習が重要です。顧客の過去の問い合わせデータを分析し、よくある質問パターンを特定してLLMに学習させることで、回答精度を向上させられます。また、エスカレーション機能により、LLMで対応困難な案件は人間のオペレーターに適切に引き継がれます。これにより、顧客は待ち時間なく適切なサポートを受けられ、企業は人件費を削減しながらサービス品質を向上させられます。

文書作成と要約・翻訳業務

ビジネス文書の作成において、LLMは大幅な時間短縮と品質向上を実現しています。報告書、提案書、メール文書の下書き作成から、会議議事録の要約、多言語文書の翻訳まで幅広い用途で活用されています。特に、大量の資料を短時間で要約する能力は、情報収集と意思決定の速度を大幅に向上させています。

実践的な活用例として、営業部門では提案書のテンプレート生成、人事部門では求人票の作成、経理部門では財務レポートの要約などが挙げられます。翻訳業務では、技術文書の専門用語も正確に翻訳でき、グローバル企業での多言語コミュニケーションを支援しています。ただし、最終的な確認と編集は人間が行う必要があり、LLMはあくまで効率化ツールとして位置づけることが重要です。品質管理プロセスを確立することで、安定した成果を得られます。

データ分析とレポート生成

LLMは複雑なデータを理解し、洞察に富んだレポートを自動生成できます。売上データ、顧客アンケート、市場調査結果などの定量・定性データを組み合わせて、経営陣向けのエグゼクティブサマリーや詳細な分析レポートを作成できます。従来は専門のアナリストが数日かけて作成していた作業を、数時間で完了させることが可能です。

具体的な活用シーンとして、月次売上レポートの自動生成、顧客満足度調査の分析、競合他社の動向分析などがあります。LLMは数値データだけでなく、テキストデータからもトレンドや課題を抽出し、実行可能な提案を含めたレポートを生成できます。メルカリの事例では、30億点を超える商品の大規模カテゴリ分類にLLMを活用し、従来手法と比較してコストと処理時間を大幅に削減しました。データドリブンな意思決定を支援する強力なツールとして注目されています。

業務効率化と生産性向上事例

LLM導入による業務効率化は、企業の競争力向上に直結しています。明治安田生命では、電話対応後のアフターコールワーク自動化により、年間約55万件の作業時間を30%削減する成果を上げています。この事例は、定型的な作業をLLMに任せることで、従業員がより創造的で付加価値の高い業務に集中できることを示しています。

製造業では、技術文書の作成、品質管理レポートの生成、安全マニュアルの更新などでLLMが活用されています。金融業界では、規制対応文書の作成、リスク評価レポートの生成、顧客向け説明資料の作成などで効果を発揮しています。重要なのは、LLMを単なる作業代行ツールとしてではなく、人間の能力を拡張するパートナーとして位置づけることです。適切な役割分担により、品質を維持しながら大幅な効率化を実現できます。

企業がLLMを選ぶ際の重要な比較ポイント

性能評価とベンチマーク指標

性能評価とベンチマーク指標

LLM選択時の性能評価では、複数のベンチマーク指標を総合的に検討することが重要です。日本語能力の評価には、llm-jp-evalなどの日本語特化ベンチマークが有効で、多肢選択質問応答(MC)、自然言語推論(NLI)、質問応答(QA)、読解(RC)の4つのカテゴリーで性能を測定できます。リコーの130億パラメータモデルは、これらの指標で2024年1月時点の最高性能を記録しています。

業務特化型の評価も重要です。カスタマーサポート用途では応答時間と回答精度、文書作成用途では生成速度と文章品質、データ分析用途では解析精度と洞察の深さを重視します。また、ファインチューニングの容易さやAPI応答速度、並行処理能力なども実運用では重要な指標です。無料トライアルや段階的導入により、実際の業務環境での性能を確認してから本格導入することを推奨します。ベンチマーク数値だけでなく、実用性を重視した評価が成功の鍵です。

コストと運用費用の考慮点

LLM導入のコスト構造は、初期費用と継続的な運用費用の両面から検討する必要があります。クラウド型サービスは初期投資を抑えられますが、利用量に応じた従量課金のため、大規模利用時は高額になる可能性があります。一方、オンプレミス導入は初期投資は大きいものの、長期的にはコスト効率が良い場合が多いです。

運用費用には、ライセンス料、API利用料、インフラコスト、保守費用、人件費が含まれます。特に、専門人材の確保と育成コストは見落とされがちですが、重要な要素です。ROI計算では、効率化による人件費削減、処理時間短縮による機会損失回避、品質向上による顧客満足度向上効果も考慮します。導入規模を段階的に拡大し、効果を確認しながら投資を増やすアプローチが一般的です。総所有コスト(TCO)の観点から3-5年の長期スパンで評価することが重要です。

セキュリティとプライバシー保護

企業でのLLM活用において、データセキュリティとプライバシー保護は最重要課題です。入力したデータが学習に使用される可能性、第三者によるデータアクセスリスク、データの保存場所と期間などを詳細に確認する必要があります。特に、機密情報や個人情報を扱う業務では、データの暗号化、アクセス制御、監査ログの取得が必須です。

対策として、プライベートクラウドやオンプレミス環境での運用、データマスキング機能の活用、入力データの事前フィルタリングなどが有効です。また、GDPR、個人情報保護法、業界固有の規制への対応も重要で、コンプライアンス要件を満たすLLMサービスの選択が必要です。定期的なセキュリティ監査、インシデント対応手順の整備、従業員向けセキュリティ教育も併せて実施することで、安全なLLM活用環境を構築できます。リスク評価を定期的に実施し、セキュリティ対策を継続的に改善することが重要です。

LLM導入時の課題とセキュリティ対策

データ漏洩リスクと情報セキュリティ

データ漏洩リスクと情報セキュリティ

LLM導入における最大のリスクは、機密情報の意図しない漏洩です。クラウド型LLMサービスでは、入力データが外部サーバーで処理されるため、機密文書や個人情報が第三者に露出する可能性があります。また、LLMが学習データとして活用される場合、企業の機密情報が他の利用者への回答に含まれるリスクも存在します。

効果的な対策として、データ分類とアクセス制御の実装が重要です。機密度レベルに応じてデータを分類し、高機密データはLLMに入力しない運用ルールを確立します。技術的対策では、データの仮名化・匿名化処理、エンドツーエンド暗号化、VPN経由での接続、プライベートインスタンスの利用などが有効です。従業員教育も重要で、LLMの適切な利用方法、禁止事項、インシデント発生時の対応手順を周知徹底する必要があります。定期的なセキュリティ監査により、運用状況をモニタリングし、継続的な改善を図ることが重要です。

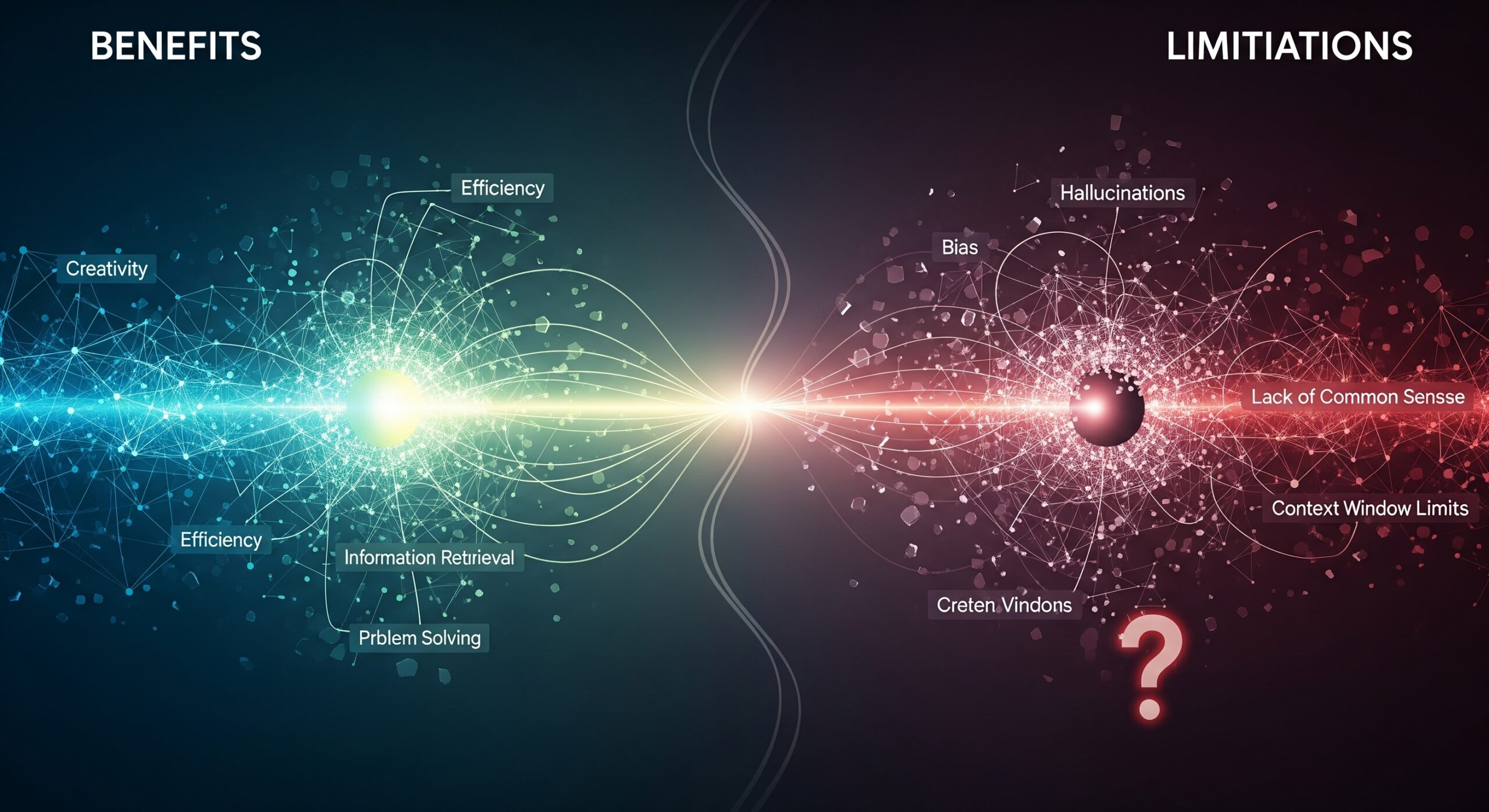

倫理的配慮とバイアス対策

LLMの出力には、学習データに含まれるバイアスが反映される可能性があります。性別、人種、宗教、職業などに関する偏見や固定観念が出力に含まれることで、差別的な内容や不適切な表現が生成される場合があります。企業利用では、これらのバイアスが顧客や従業員に悪影響を与え、法的リスクや評判悪化につながる可能性があります。

対策として、多様性に配慮した学習データの選定、バイアス検出ツールの活用、人間による出力チェック体制の確立が重要です。特に、採用活動、融資審査、医療診断支援などの重要な意思決定にLLMを活用する場合は、厳格なバイアス評価が必要です。また、透明性のあるAI活用方針の策定、倫理委員会の設置、定期的な倫理研修の実施などにより、組織全体で倫理的なAI活用を推進します。出力結果の説明可能性を高め、意思決定プロセスの透明化を図ることも重要な取り組みです。

コスト管理と投資対効果

LLM導入のコスト管理では、予期しない費用増加への対策が重要です。従量課金制のサービスでは、利用量の急増により予算を大幅に超過するリスクがあります。特に、API呼び出し回数、処理トークン数、計算リソース使用量が想定を上回る場合、高額な請求が発生する可能性があります。

効果的な対策として、利用量の上限設定、予算アラートの設定、定期的な利用状況モニタリングが必要です。ROI測定では、効率化による時間短縮効果、品質向上による顧客満足度向上、新規ビジネス創出効果を定量化します。明治安田生命の事例のように、具体的な削減時間数や削減率を測定することで、投資効果を明確に示せます。段階的導入により、小規模から始めて効果を確認しながら拡大することで、リスクを最小化しながら最大効果を得られます。継続的な効果測定と改善により、長期的な価値創出を実現することが重要です。

運用体制と人材育成

LLM導入成功には、適切な運用体制と専門人材の確保が不可欠です。技術面では、プロンプトエンジニアリング、ファインチューニング、API統合などのスキルが必要で、運用面では、品質管理、セキュリティ監視、ユーザーサポートなどの体制整備が重要です。しかし、これらの専門知識を持つ人材は市場で不足しており、採用競争が激化しています。

効果的なアプローチとして、既存従業員のスキルアップ、外部専門家との連携、段階的な知識移転などが挙げられます。社内教育プログラムでは、LLMの基礎知識、実践的な活用方法、リスク管理、倫理的配慮などを体系的に学習させます。また、変化管理も重要で、LLM導入による業務プロセスの変更に対する従業員の不安や抵抗を軽減し、円滑な移行を支援する必要があります。継続的な学習環境の整備、成功事例の共有、改善提案制度の導入により、組織全体でLLM活用能力を向上させることが成功の鍵です。

LLMの学習リソースと効果的な活用法

おすすめ書籍と学習教材

おすすめ書籍と学習教材

LLM学習の基礎固めには、体系的な書籍学習が効果的です。「大規模言語モデル入門」は、理論と実装の両面からLLMを解説し、Hugging FaceのTransformersライブラリを用いた実装方法も詳しく説明されています。「大規模言語モデルは新たな知能か ChatGPTが変えた世界」は、LLMの社会的影響と技術的側面を多角的に分析した良書です。

実践的な学習には、「作ってわかる!自然言語処理AI」がおすすめで、TransformerやBERTの実装を通じて深い理解が得られます。「OpenAI GPT-4/ChatGPT/LangChain 人工知能プログラミング実践入門」は、最新のAPI活用方法とアプリケーション開発手法を学べます。これらの書籍は、初心者から上級者まで段階的に学習でき、理論と実践のバランスが取れた構成になっています。読書と並行して、実際にコードを書いて動かすことで、より深い理解が得られます。

オンライン講座と実践的トレーニング

最新技術の習得には、オンライン講座や実践的トレーニングが有効です。東京大学松尾・岩澤研究室が提供する「LLM大規模言語モデル講座」は、2024年度版として基礎編と応用編の2部構成で無償提供されており、延べ6,000名の受講実績を持つ高品質な講座です。LLMの原理から社会実装まで体系的に学べます。

実務スキル向上には、Coursera、Udemy、edXなどのプラットフォームで提供される専門講座も効果的です。Hugging Faceの公式チュートリアル、OpenAIのドキュメント、Google Cloudの機械学習コースなども実践的な学習に適しています。重要なのは、座学だけでなく実際にAPIを使用したり、小規模なプロジェクトを実装したりして、手を動かしながら学習することです。GitHubで公開されているプロジェクトに参加することで、実践的なスキルを効率的に身につけられます。

効果的な学習戦略とスキル習得方法

LLM習得の効果的な戦略は、段階的なスキル構築と実践重視のアプローチです。まず、機械学習とPythonの基礎を固め、次に自然言語処理の基本概念を理解し、最後にLLM固有の技術を学習するという順序が効果的です。各段階で小さなプロジェクトを実施し、理解を確認しながら進めることが重要です。

実践的なスキル習得では、プロンプトエンジニアリング、ファインチューニング、RAG(Retrieval-Augmented Generation)などの技術を重点的に学習します。また、LangChain、LlamaIndex、Hugging Face Transformersなどの主要ライブラリの使い方をマスターすることも重要です。学習コミュニティへの参加、技術ブログの執筆、カンファレンスへの参加などにより、最新動向をキャッチアップし、ネットワークを構築することで、継続的な成長が可能になります。定期的な振り返りと学習計画の見直しにより、効率的なスキル向上を実現できます。

LLMの未来展望と2025年以降のトレンド

技術発展の予測と次世代モデル

技術発展の予測と次世代モデル

2025年以降のLLM技術発展では、マルチモーダル機能の高度化が最重要トレンドとなります。現在のGPT-4oやGemini 2.0が示すように、テキスト、画像、音声、動画を統合処理できるモデルが主流になると予測されます。特に、リアルタイム処理性能の向上により、会議での同時通訳、動画コンテンツの自動生成、インタラクティブな教育システムなどが実現されるでしょう。

効率化技術も重要な発展領域です。現在のLLMは膨大な計算リソースを必要としますが、蒸留技術、プルーニング、量子化などにより、より少ないリソースで高性能を実現するモデルが登場します。エッジデバイスでの動作も可能になり、プライバシー保護とレスポンス向上を両立できます。また、専門分野特化型LLMが増加し、医療、法律、金融などの分野で人間の専門家を上回る性能を持つモデルが登場すると予想されます。継続学習機能により、リアルタイムで新しい知識を習得するLLMも実現されるでしょう。

市場動向と産業への影響

LLM市場は2025年以降も急速な拡大が予想され、特に企業向けソリューション市場の成長が著しいとされています。ガートナーの予測では、2027年までに大企業の40%以上が何らかの形でLLMを活用すると見込まれています。産業別では、金融サービス、ヘルスケア、教育、製造業での導入が加速し、業務プロセスの根本的な変革が進むでしょう。

雇用への影響も significant です。定型的な事務作業、基本的な文書作成、初級レベルのプログラミングなどの職種では自動化が進む一方、LLMを効果的に活用できるスキルを持つ人材の需要は急増します。新しい職種として、AIプロンプトエンジニア、AIエシックス専門家、人間-AI協働コーディネーターなどが生まれると予想されます。企業は人材の再教育に投資し、AI時代に適応した組織作りを進める必要があります。規制面では、AI活用に関する法整備が進み、責任あるAI活用が求められるようになります。

新たな活用領域と可能性

LLMの活用領域は従来の予想を超えて拡大しており、創造性を要する分野でも革新が期待されます。映画脚本の執筆、楽曲の作詞作曲、ゲームのシナリオ作成など、エンターテイメント産業での活用が本格化するでしょう。また、個人化教育システム、精神的健康支援、高齢者向けコンパニオンロボットなど、人間の感情や個性に寄り添うアプリケーションも発展します。

科学研究分野では、論文の自動要約、仮説生成、実験計画の立案など、研究プロセス全体をLLMが支援するようになります。創薬研究では、分子構造の最適化、薬効予測、副作用分析にLLMが活用され、開発期間の大幅短縮が期待されます。社会課題解決では、気候変動対策、貧困削減、災害対応などの複雑な問題に対して、LLMが多角的な分析と解決策提案を行うようになるでしょう。これらの発展により、LLMは単なるツールから、人類の知的活動を拡張するパートナーへと進化していくと考えられます。

まとめ:LLMを理解して活用するための次のステップ

重要ポイントの総括

重要ポイントの総括

LLM(大規模言語モデル)は、現代ビジネスの競争力を左右する重要技術となっています。本記事で解説した通り、LLMは膨大なデータと高度なアルゴリズムにより、人間のような自然な言語理解と生成を実現し、業務効率化から新しいビジネスモデル創出まで幅広い価値を提供します。2024年の最新動向では、GPT-4o、o1、Gemini 2.0などの革新的モデルが登場し、マルチモーダル機能と推論能力が大幅に向上しました。

成功する導入のためには、適切なモデル選択、セキュリティ対策、コスト管理、人材育成の4つの要素が重要です。特に、データプライバシー保護と倫理的配慮は、持続可能なLLM活用の前提条件となります。また、LLMは完璧ではなく、人間との協働により最大の価値を発揮することを理解し、適切な役割分担を設計することが成功の鍵です。継続的な学習と改善により、LLM活用能力を組織全体で向上させることで、長期的な競争優位を築けます。

実践的アクションプラン

LLM活用を始めるための具体的なアクションプランとして、まず小規模なパイロットプロジェクトから開始することを推奨します。文書要約、メール作成支援、FAQ対応など、リスクが低く効果を測定しやすい用途から始め、成功体験を積み重ねながら段階的に拡大します。同時に、従業員向けの基礎教育を実施し、LLMの適切な利用方法とリスク管理について理解を深めます。

中期的には、業務プロセスの分析を行い、LLMによる効率化効果が高い領域を特定します。ROI計算を行い、投資対効果を明確にした上で本格導入を進めます。長期的には、競合優位性の源泉となる独自のLLM活用方法を開発し、組織のデジタル変革を推進します。重要なのは、技術導入だけでなく、組織文化の変革も並行して進めることです。LLMを活用した新しい働き方を定着させ、継続的なイノベーションを生み出せる組織作りが、2025年以降の成功を決定する要因となるでしょう。

※本記事にはAIが活用されています。編集者が確認・編集し、可能な限り正確で最新の情報を提供するよう努めておりますが、AIの特性上、情報の完全性、正確性、最新性、有用性等について保証するものではありません。本記事の内容に基づいて行動を取る場合は、読者ご自身の責任で行っていただくようお願いいたします。本記事の内容に関するご質問、ご意見、または訂正すべき点がございましたら、お手数ですがお問い合わせいただけますと幸いです。

トークン化とデータ前処理

トークン化とデータ前処理 OpenAI GPTシリーズ(GPT-4o、o1)

OpenAI GPTシリーズ(GPT-4o、o1) LLM、生成AI、ChatGPTの概念整理

LLM、生成AI、ChatGPTの概念整理 カスタマーサポートと問い合わせ対応

カスタマーサポートと問い合わせ対応 性能評価とベンチマーク指標

性能評価とベンチマーク指標 データ漏洩リスクと情報セキュリティ

データ漏洩リスクと情報セキュリティ おすすめ書籍と学習教材

おすすめ書籍と学習教材 技術発展の予測と次世代モデル

技術発展の予測と次世代モデル 重要ポイントの総括

重要ポイントの総括