ChatGPTと大規模言語モデルの違いとは?仕組みから活用法まで徹底解説

この記事は、ChatGPTと大規模言語モデル(LLM)の違いと関係性を基礎から整理し、仕組み・進化・日本語特化型モデルの必要性までを体系的に解説しています。

さらに、ビジネス導入のフレームワークやROI算出、セキュリティ対策、業界別活用事例を具体的に紹介し、実践的な指針を提示しています。

最後に、ハルシネーションやバイアスへの対策、AGIやマルチモーダルAIの未来展望を示し、責任あるAI活用と将来のビジネスインパクトについてまとめています。

ChatGPTはLLM(大規模言語モデル)という技術を活用して作られた対話サービスで、LLMはその土台となる基盤技術だ。「技術そのもの」と「その技術を使ったサービス」という関係を押さえれば、両者の違いはすっきり整理できる。

本記事では、LLMとChatGPTの技術的な仕組みの違いから、他社AIサービスとの比較、日本語対応LLMの最新動向、ビジネス導入の実践的な手順まで体系的に解説する。AI活用を検討している経営者・マーケター・IT担当者に向けて、選定判断に直接使える情報を中心にまとめている。

ChatGPTと大規模言語モデル(LLM)の基本概念

ChatGPTとは何か

ChatGPTは、OpenAIが2022年11月にリリースした対話特化型のAIサービスだ。公開後わずか2か月でユーザー数1億人を突破し、生成AIへの関心を一気に引き上げた。

最大の特徴は「文脈を保ちながら対話を続けられること」にある。従来のチャットボットは事前に用意した回答パターンを返すだけだったが、ChatGPTは会話の流れを把握して毎回の返答を生成する。文章作成・翻訳・コーディング・アイデア出しなど、一つのツールで幅広い業務をこなせるのはそのためだ。

現在は無料で利用できる基本版のほか、有料のPlus・Pro・Teamプランがあり、プランに応じてより高性能なモデルや画像生成・音声対話などの機能が利用できる。

大規模言語モデル(LLM)とは何か

大規模言語モデル(Large Language Model:LLM)は、インターネット上の膨大なテキストを学習し、人間のような自然な文章を生成するAI技術だ。数百億から数千億個のパラメータを持つニューラルネットワークで構成されており、言語の意味・文脈・ニュアンスを確率的に処理する。

基本的な動作原理は「次に来る単語を予測する」ことだ。「今日の天気は」という入力に対して、「晴れ」「曇り」「雨」などの候補を確率で比較し、最も適切な単語を選ぶ。この処理を繰り返すことで、まとまりのある文章が生成される。

現代のLLMが持つ主な能力は次の4点だ。文章の長い流れを把握して一貫した回答を返す「文脈理解」、複数言語を扱う「多言語対応」、特定用途に限定されない「汎用性」、そして学習データに含まれないタスクも一定程度こなす「創発能力」がある。

ChatGPTとLLMの関係性

ChatGPTとLLMの関係は、「LLMという技術基盤の上に構築されたサービスがChatGPT」として理解するとわかりやすい。

OpenAIが開発したGPT(Generative Pre-trained Transformer)シリーズというLLMをベースに、対話に特化した追加学習を施したものがChatGPTだ。GPTというエンジンを積んで、対話インターフェースという車体を整えた完成車がChatGPT、と捉えればよい。

現在、ChatGPT以外にも多数のLLMベースサービスが登場している。GoogleのGemini、AnthropicのClaude、MicrosoftのCopilotなどはいずれもこの構造を持つ。各サービスの違いは「どのLLMを採用し、どのような最適化をかけているか」にある。

生成AIエコシステムにおけるLLMの位置づけ

生成AIはテキスト生成だけを指す言葉ではない。テキストはLLM(GPT・Claude・LLaMAなど)、画像は拡散モデル(DALL-E・Midjourneyなど)、音声は音声合成モデル(ElevenLabsなど)、動画は動画生成モデル(Runwayなど)がそれぞれ担当する分業構造になっている。

LLMはその中でも中核的な役割を果たしており、他のモデルと連携してマルチモーダルなサービスを構成する基盤にもなっている。ChatGPTの最新版が画像・音声・テキストをまとめて扱えるのも、LLMを中心に各機能が統合された結果だ。

ビジネスへの影響という観点では、コンテンツ作成・カスタマーサポート・社内ナレッジ検索・ソフトウェア開発など、テキストを扱うあらゆる業務でLLM活用の余地がある。人間が行っていた定型的な文章業務をLLMが代替することで、生産性向上とコスト削減の両方を実現している企業が増えている。

大規模言語モデルの技術的仕組み

言語モデルの基本原理

LLMの基本原理は「確率的な言語予測」だ。大量のテキストデータから単語の出現パターンを学習し、与えられた文脈に対して最も適切な次の単語を確率計算で選び続ける。

以前主流だったN-gram手法は、直前のN個の単語だけから次の単語を予測するシンプルな統計モデルで、長い文脈を保持することが苦手だった。現代のLLMはニューラルネットワークを使い、数万トークン規模の文脈を同時に処理できる。

学習は大きく3段階に分かれる。まず大量の生テキストで基本的な言語理解を身につける「事前学習(Pre-training)」、次に高品質な対話例で特定タスクへの対応力を磨く「教師あり微調整(SFT)」、そして人間の評価フィードバックを使ってモデルをさらに改善する「強化学習(RLHF)」だ。ChatGPTが自然で安全な対話を実現しているのは、この3段階の学習プロセスが効いている。

Transformerアーキテクチャとは

現代のLLMの骨格を成すのが、2017年にGoogleの研究チームが発表したTransformerアーキテクチャだ。「Attention Is All You Need」という論文で提唱され、自然言語処理の性能を根本から塗り替えた。

中核をなすのが「Attention(注意)メカニズム」だ。文章内の各単語が、他のすべての単語とどの程度関係しているかを動的に計算する仕組みで、従来のように単語を順番に処理する必要がなく、全単語を同時に並列処理できる。

たとえば「彼は本を読んだ後、それを棚に戻した」という文で「それ」が何を指すかを判断する際、Attentionメカニズムは文全体を参照して「本」との関係を高くスコアリングし、正確な解釈を行う。この仕組みにより、長文でも文脈の一貫性が保たれる。並列処理の実現は学習・推論の大幅な高速化にもつながり、大規模モデルの実用化を可能にした。

テキストが生成されるプロセス

LLMがテキストを出力するまでには、4つの処理段階がある。

①トークン化(Tokenization) 入力テキストを「トークン」と呼ばれる小単位に分割する。日本語では文字・単語・文字の組み合わせなどがトークン単位になる。「ChatGPTは便利です」なら「Chat」「GPT」「は」「便利」「です」のように分割される。

②エンコーディング(Encoding) 各トークンを数値ベクトルに変換し、意味と文章中の位置情報を数学的に表現する。コンピュータが言語の意味を処理できる形に変換する工程だ。

③予測と生成 エンコードされた情報を元に、Transformerネットワークが次に来るトークンの確率分布を計算し、最も確率の高いものを選ぶ。これを繰り返して文章を伸ばしていく。

④デコーディング(Decoding) 生成されたトークン列を人間が読める自然言語に戻し、句読点や改行を整えて出力する。

パラメータ数と性能の関係

LLMの性能に大きく影響するのがパラメータ数だ。パラメータとはニューラルネットワーク内で学習される数値で、多いほど複雑なパターンを学習できる傾向がある。

GPTシリーズのパラメータ数の推移を見ると、初代GPT-1(2018年)の約1.2億から、GPT-2(2019年)で15億、GPT-3(2020年)で1,750億へと急拡大してきた。GPT-4(2023年)以降はOpenAIが公式な数値を非公表としており、推定値が出回っているに過ぎない。

ただし近年の研究では、単純にパラメータ数を増やすより、学習データの品質向上や学習手法の改善が性能向上に効果的なケースも多いとわかってきた。GPT-3に匹敵する性能をはるかに小さなモデルで実現する手法も登場しており、効率と性能のバランスをどう取るかが重要な設計課題になっている。

ChatGPTの技術的進化と独自性

GPTシリーズの発展(GPT-1からGPT-4まで)

GPT-1(2018年) Transformerアーキテクチャを言語生成タスクに初めて本格適用したモデル。事前学習+微調整のアプローチを確立し、1つのモデルで複数のNLPタスクに対応できることを示した。ただしパラメータ数は約1.2億にとどまり、長文の一貫性に課題があった。

GPT-2(2019年) パラメータ数を15億に拡張。人間が書いたような自然な文章を生成できるようになり、当初はOpenAI自身が悪用を懸念して完全版の公開を控えるほど注目を集めた。零ショット(例なし)での各種タスク実行能力も向上した。

GPT-3(2020年) 1,750億パラメータという規模で、数例の例示(Few-shot学習)だけで新しいタスクをこなす汎用性を獲得した。生成テキストと人間の文章を区別しにくいレベルに到達し、APIによる商用展開が本格化した。

GPT-4(2023年) テキストと画像を同時に処理するマルチモーダル機能を実装。専門的な推論能力も大幅に向上し、米国司法試験で上位10%に相当するスコアを記録した。最大32,768トークンの長文処理にも対応した。

RLHFがChatGPTの対話品質を決定づけた理由

ChatGPTが従来のLLMと一線を画す最大の要因が、RLHF(Reinforcement Learning from Human Feedback=人間からのフィードバックによる強化学習)だ。

従来のLLMは「次の単語を正確に予測すること」に最適化されており、文法的に正しくても役に立たない・有害な・不誠実な回答を生成することがあった。RLHFはこの問題を3段階で解決する。

- 人間のトレーナーが高品質な対話例を作成し、GPT-3ベースモデルを微調整する

- 複数の回答候補に対して人間が品質順位をつけ、「報酬モデル」を訓練する

- 報酬モデルを使った強化学習(PPOアルゴリズム)でモデル全体を最適化する

この仕組みにより、ChatGPTは「人間にとって有用で、安全で、誠実な回答」を継続的に生成できるようになった。ユーザーが「いいね/よくない」ボタンで評価したフィードバックも継続的な改善に活用されている。

対話特化の最適化が生み出す体験

ChatGPTは単なるテキスト生成ツールではなく、対話専用の最適化が重ねられたサービスだ。「先ほど話した件について教えて」という曖昧な参照でも、会話履歴から文脈を判断して回答する「文脈保持機能」がその代表例だ。

また、プログラミングの質問には技術的に詳細な回答を、キャリア相談には共感的なトーンでの回答を返すように、指示された役割や専門領域に応じて回答スタイルを切り替える「役割適応能力」も持つ。違法行為や差別的内容の生成は拒否しながらも、教育的・建設的な情報提供は行うという安全性と有用性のバランスも、対話特化の最適化から生まれている。

マルチモーダル機能の実装

GPT-4以降のChatGPTでは、テキスト・画像・音声を組み合わせた処理が可能になっている。

画像をアップロードすれば内容を分析・説明し、手書きのスケッチからWebページのコードを生成することもできる。DALL-E 3との統合により、テキストの指示だけでプロフェッショナルレベルの画像を生成できる機能も提供されている。2023年9月には自然な音声対話機能が追加され、テキスト入力が難しい状況での利用を可能にした。

これらの機能は独立して動作するのではなく、画像について音声で質問してテキストで回答を受け取るなど、複数のモダリティを組み合わせた自然な対話体験として統合されている。

ChatGPTと他の大規模言語モデルの比較

ChatGPTの市場ポジション

ChatGPTが広範なユーザーに支持される理由は、対話体験への徹底した最適化と、ユーザーフレンドリーなインターフェースの組み合わせにある。RLHFによる自然な応答、長い会話の文脈保持、安全性と有用性のバランス調整など、「人間との対話」に特化した改良が重ねられている。

専門知識がなくても使い始められる設計と、スマートフォンアプリ・APIの充実も幅広い支持の背景だ。ただし競合他社の急速な追い上げにより、2025年現在では特定用途において他サービスがChatGPTを上回る場面も増えている。

主要AIサービスの最新比較(2025年)

2025年時点の主要AIサービスを比較する。

| サービス | 開発元 | 最新モデル | コンテキスト長 | 特徴 |

|---|---|---|---|---|

| ChatGPT | OpenAI | GPT-4o / o3シリーズ | 最大128K〜 | 対話品質・汎用性、最大ユーザー基盤 |

| Gemini | Gemini 2.5 Pro | 最大100万トークン(2.5 Flash) | Googleサービス連携、圧倒的なコンテキスト長、Web検索統合 | |

| Claude | Anthropic | Claude Opus 4.6 / Sonnet 4.6 | 標準200K、最大100万トークン | 安全性・倫理性、長文処理、コーディング性能 |

| Copilot | Microsoft | GPT-4o採用 | — | Microsoft 365との深い統合 |

Google Gemini(旧Bard) Googleは2024年2月にBardをGeminiへ改称した。2025年現在の最新モデルはGemini 2.5 ProとGemini 2.5 Flashで、100万トークンのコンテキストウィンドウを標準で備え、WebDev ArenaおよびLMArenaの両リーダーボードでトップを記録している。 Google GmailやGoogleドライブなど既存のGoogleサービスとの連携も強力で、Web検索とAI回答を統合した情報収集用途に強い。

Anthropic Claude AI安全性の研究機関Anthropicが開発するLLMで、Constitutional AI(憲法AI)という独自手法で倫理的・安全な応答を設計段階から組み込んでいる。2026年2月リリースのOpus 4.6ではコーディングや長時間エージェント作業での信頼性を強化し、100万トークンの長文コンテキストにも対応した。 Wikipedia 標準コンテキスト長は200Kトークン(約150,000語・500ページ以上に相当)で、法的文書や研究論文など長い資料の分析に適している。

Microsoft Copilot OpenAIとの提携によりGPT-4oをベースとし、Microsoft 365(Word・Excel・Teams等)との深い統合を特徴とする。既存のMicrosoft環境を使う企業にとって、ツール切り替えなしでAI機能を導入できる点が強みだ。

オープンソースLLMとの比較

商用サービスに対し、自社サーバーで動かせるオープンソースLLMも企業の有力な選択肢になっている。

Metaが開発するLlamaシリーズ(最新はLlama 3.3)は商用利用可能なオープンソースLLMの代表格で、複数のパラメータサイズが提供されている。フランスのMistral AIも、比較的小さなモデルサイズで高い性能を実現するモデルを継続的に公開している。

オープンソースLLMの主な利点は、データのクラウド送信が不要でプライバシーを完全に管理できること、自社環境に合わせたカスタマイズが自由にできること、API利用料が不要で大量利用時のコスト管理が容易なことだ。一方で、サーバー構築・保守の技術的負担と初期投資が発生し、安全性対策も自社で実装する必要がある。

用途別の選択基準

どのLLMサービスを選ぶかは、目的と要件によって異なる。判断の出発点となるフレームワークを示す。

- 日常的な対話・文章作成・汎用的なタスク → ChatGPT(対話品質と汎用性のバランスが最も高い)

- 最新情報の調査・Googleサービス連携 → Gemini(リアルタイムWeb検索、100万トークン超のコンテキスト)

- 長文分析・法的文書・コーディング支援 → Claude(200K〜100万トークンの文脈処理、安全性重視の設計)

- Microsoft 365環境での業務効率化 → Copilot(Officeとの深い統合、既存ワークフローへの組み込み)

- データプライバシー確保・大量利用コスト削減 → オープンソースLLM(Llama、Mistralなど)

選定時に必ず確認すべき要件は、データプライバシー(クラウドに送信してよいデータかどうか)、利用規模とコスト構造、既存システムとのAPI連携要件、業界規制・コンプライアンス対応の4点だ。

日本語対応LLMの現状と課題

日本語特化型LLMが必要な理由

海外製LLMの多くは英語中心に学習されており、日本語特有の課題への対応力に限界がある。

日本語は世界でも特に複雑な言語構造を持つ。ひらがな・カタカナ・漢字が混在し、単語間にスペースがないためトークン化が難しい。敬語は尊敬語・謙譲語・丁寧語の3系統に細分化され、相手との関係や場面に応じた使い分けが必要だ。「察する」「空気を読む」といった日本文化特有の暗黙の前提を正確に処理することも、英語中心モデルには難しい。

企業・政府機関にとってはデータ主権の問題も大きい。機密情報を海外のAIサービスに送信することへのリスクを避けるニーズや、日本の個人情報保護法・業界規制に完全に準拠したAIサービスへの需要が国産LLM開発を後押ししている。

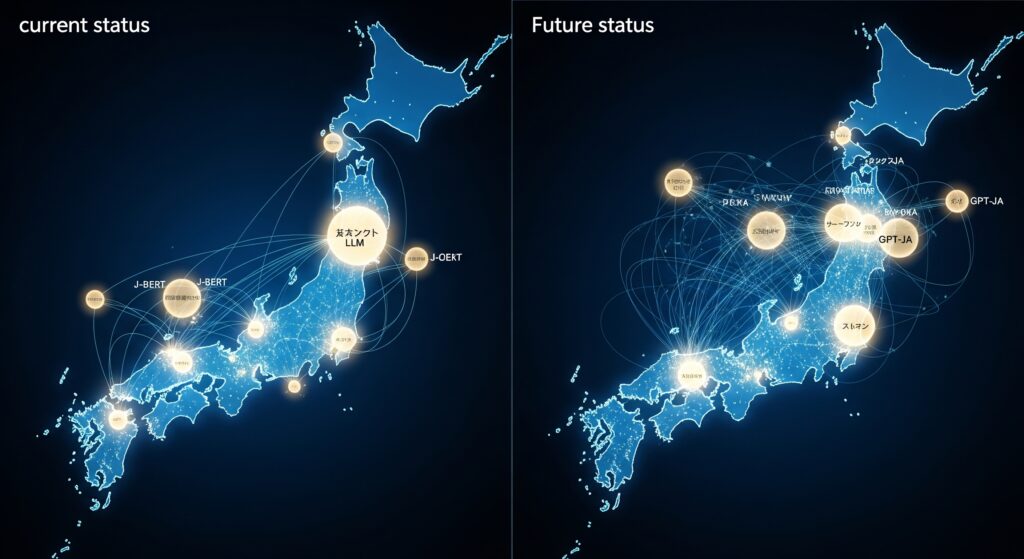

国産LLMの最新動向(2025年)

2024〜2025年にかけて、日本企業による国産LLM開発は実用化段階に入った。

NTT「tsuzumi 2」 NTTは2025年10月20日、純国産LLM「tsuzumi 2」の提供を開始した。初代tsuzumiのパラメータ数70億(7B)から300億(30B)に拡大し、日本語の理解・生成性能が大幅に向上した。 Nikkei 最大の特徴はオープンソースモデルを利用せずフルスクラッチで開発されている点で、学習データの著作権・品質・バイアスを完全にコントロールできる。1つのGPUで動作する軽量設計を維持し、オンプレミス環境でのセキュアな運用が可能だ。金融・医療・公共分野の専門知識を重点強化しており、デジタル庁が推進する行政AI基盤「源内(げんない)」向けの国産LLMにも選定されている。 Impress Watch

サイバーエージェント「CyberAgentLM3」 225億パラメータの日本語LLMをApache License 2.0(商用利用可能)で公開。他社の既存モデルをベースにせずスクラッチ開発された点が特徴で、日本語能力ベンチマーク(Nejumi LLMリーダーボード)でMeta製700億パラメータモデルと同等の性能を達成している。

Preferred Networks「PLaMo 2.0」 KDDI/ELYZAのLlama系モデルとともに、デジタル庁のガバメントAI選定モデルの一つとなっている。 Impress Watch

国産LLMの共通した強みは、日本語の専門用語・敬語・業界固有表現への対応力と、国内法に準拠したデータ管理体制にある。一方、汎用的な対話品質や多言語対応では海外大手モデルに差があるのが現状だ。

日本語処理における技術的課題

日本語LLMの開発には複数の技術的ハードルがある。

単語間にスペースがない日本語はトークン化の単位設計が難しく、文字・形態素・サブワードの各方式にそれぞれ長所と短所がある。英語に比べて高品質な学習データの絶対量が少ないことも、モデルの精度に影響する。

省略が多用される日本語の文構造(主語・目的語の頻繁な省略)は、文脈から省略要素を補完する高度な推論を必要とする。「そうですね」のように、同意・困惑・時間稼ぎなど文脈によって意味が変わる表現の処理も課題だ。

敬語・文脈理解の精度向上への取り組み

各社は日本語特有の課題に対して複数のアプローチで取り組んでいる。敬語使用のルールと実際の使用例を組み合わせた学習データセットを整備し、ビジネス・医療・教育など分野別にファインチューニングを行う方法が主流だ。

文脈補完の精度向上では、談話構造の理解を深めるモデル設計が進んでいる。省略された主語を前後の流れから特定する能力は、日本語LLMの実用性を左右する重要な指標になっている。

従来の機械翻訳評価指標では捉えきれない「日本語の自然さ」や「敬語の適切さ」を測定するための独自評価指標の開発も進んでおり、より実践的なモデル改善が可能になってきている。

ビジネス活用における実践ガイド

企業導入時の検討フレームワーク

LLMの企業導入を成功させるには、技術選定だけでなく目的・組織・リスクを含む包括的な検討が必要だ。

導入目的の定量化 「業務効率化」という抽象的な目標ではなく、「カスタマーサポートの初期対応時間を50%短縮」「月次レポート作成工数を週5時間から2時間に削減」といった測定可能な目標を設定する。達成水準が明確でないとROI評価も改善の方向性も定まらない。

適用領域の選定 LLMが効果を出しやすい業務と、慎重な検討が必要な業務を分けて考える。定型文書の起草・問い合わせ対応の初期分類・データサマリーは効果が出やすい領域だ。一方、最終的な法的判断・医療診断・財務決定など、専門的な責任を伴う意思決定はLLMを補助ツールとして位置づけ、人間が最終確認する体制が必須だ。

技術要件と組織要件の並行整理 API連携の仕様・セキュリティ要件・既存システムとの統合方法を技術側で整理する一方で、利用ガイドラインの策定・従業員トレーニング・ワークフローの再設計を組織側で進める。技術導入だけ先行して組織面が追いつかないケースが最も多い失敗パターンだ。

ROIの算出方法

LLM導入のコストは、初期費用(ライセンス・システム統合・カスタマイズ・トレーニング)と運用費用(月次利用料・保守・継続トレーニング・モニタリング)に分かれる。API従量課金型では利用量に応じてコストが変動するため、想定利用パターンを事前に詳細に見積もることが重要だ。

効果の測定は直接的効果と間接的効果の両面で行う。直接的効果は作業時間短縮(時間単価×削減時間)・エラー率低下(修正コスト削減)・対応速度向上(顧客満足度への影響)として数値化できる。間接的効果には従業員が付加価値の高い業務に集中することによる生産性向上、サービス品質改善による顧客維持率の変化などがある。

ROI算出時の注意点は、効果数値を過大評価しないことだ。パイロット段階では実際の業務に近い条件で小規模テストを行い、「想定効果の何割が実際に達成できたか」を検証してから本格展開の判断をする。

セキュリティ・プライバシー対策の実装

LLMの企業利用で最初に整備すべきなのがデータ分類ルールだ。個人情報・顧客データ・財務情報・技術仕様書・戦略文書はLLMへの入力を制限するか、事前に匿名化・マスキング処理を施すことを社内ガイドラインで明確に定める。

技術的な保護措置としては、API通信の暗号化・アクセス制御(誰がどのLLMを使えるか)・入出力ログの記録と定期監査が基本セットとなる。

法規制対応では、個人情報保護法・GDPR(EU域内取引がある場合)への準拠確認に加え、金融分野のFISC安全対策基準・医療分野のガイドライン・政府機関の情報セキュリティポリシーなど業界固有の要件も確認する。

なお、オンプレミス型の国産LLM(tsuzumi 2等)を採用する場合は、データがクラウドに送信されないため、機密情報の取り扱い要件が厳しい企業・官公庁にとって有力な選択肢になる。

業界別活用事例

製造業 部品・設備のトラブル対応記録をLLMで検索・分析し、類似障害への対処法を即座に提示するシステムで、技術者の問題解決時間の短縮と設備稼働率向上を実現している企業がある。多言語対応の技術マニュアル自動生成により、海外拠点への技術移転を効率化する活用例も広がっている。

金融業 住宅ローン・保険などの相談業務において、顧客の質問をLLMが分析して適切な商品と必要書類を提示するシステムを導入し、相談員の負担軽減と提案品質の標準化を両立している地方銀行がある。契約書・提案書のコンプライアンスチェックへのLLM活用も進んでいる。

医療・ヘルスケア 診療記録の下書き作成支援や患者向け説明資料の生成で、医師の事務作業時間を削減する導入が広がっている。ただし診断・治療方針の決定は必ず医師が行い、LLMは情報提供と業務支援に限定するという運用原則の徹底が不可欠だ。

小売・EC 商品の特徴データを入力するだけで、ターゲット顧客に合わせた商品説明文を自動生成するシステムで、出店者の商品登録作業を大幅に削減し、説明文の品質均一化を実現している大手ECプラットフォームがある。24時間対応のカスタマーサポート自動化でも成果が出ている。

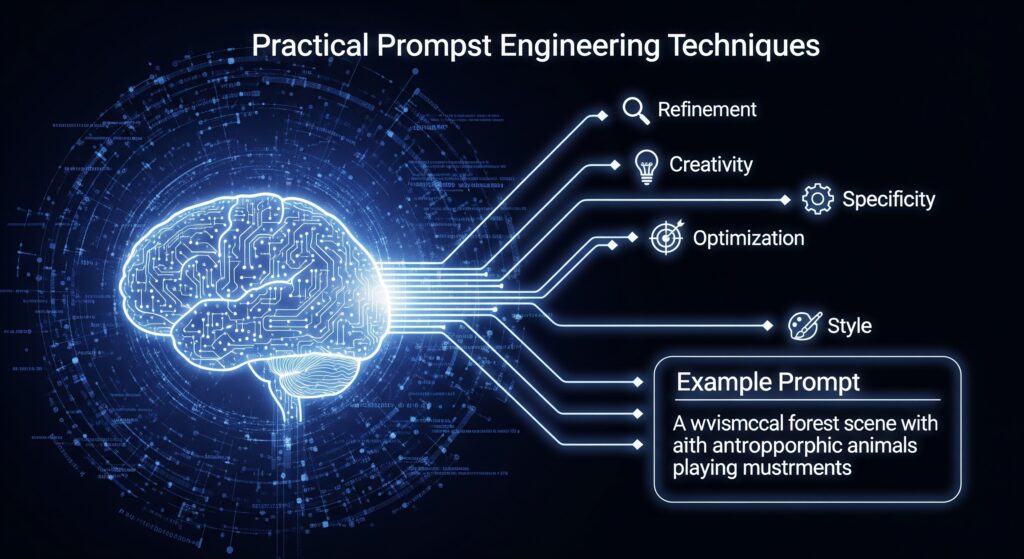

プロンプトエンジニアリングの実践テクニック

効果的なプロンプト設計の基本原則

同じLLMでも、プロンプトの書き方一つで出力の品質は大きく変わる。効果的なプロンプトには4つの要素がある。

①具体性と明確性 「文章を書いて」ではなく「新製品のプレスリリースを300字以内で、30代女性向けに、環境配慮の特徴を強調して書いて」のように、目的・分量・対象読者・重点を明示する。

②文脈情報の提供 「IT企業の人事担当者として、リモートワーク導入に関する社内向けガイドラインを作成する」という設定を加えるだけで、より実践的な内容が生成される。背景情報が多いほど的を絞った出力が得られる。

③出力形式の指定 「箇条書きで5項目」「比較表形式」「JSON形式で出力」など、後工程で使いやすい形式を指定する。形式を指定しないとLLMが判断した形式で出力され、加工に余分な手間がかかる。

④制約条件の明示 使ってはいけない表現・遵守すべきガイドライン・避けるべきトーンなどを明記する。コンプライアンス要件を持つ業種では特に重要な要素だ。

Zero-Shot・One-Shot・Few-Shot学習の使い分け

Zero-Shot:例示なしで指示だけでタスクを実行させる手法。翻訳・要約・汎用的な質問応答など、LLMが事前学習で十分な知識を持っている標準的なタスクに適している。プロンプトが短く、コスト効率が高い。

One-Shot:1つの具体例を示してから本番タスクを依頼する手法。特定の出力形式や品質レベルを求める場合に効果的。例の選択が結果に直結するため、最も代表的で高品質な例を選ぶ。

Few-Shot:2〜5個の例を示してパターンを学習させる手法。複雑なタスク・特殊な形式・微妙なニュアンスが必要な場合に最も効果的。例のバリエーションを持たせることで、多様な入力に対して安定した出力が得られる。

基本的な目安として、一般的な業務はZero-Shotから始め、出力品質が不十分な場合にOne-Shot→Few-Shotとエスカレーションしていく順序が効率的だ。

業務別プロンプト最適化の具体例

マーケティング 詳細なペルソナ情報(年代・職業・ライフスタイル・価値観)を含めることで、ターゲット心理に刺さるコンテンツが生成される。以下はSNS投稿用コピー作成のプロンプト構成例だ。

【ペルソナ】35歳女性、会社員、2児の母、環境・健康志向

【タスク】オーガニック食品の新商品SNS投稿コピーを作成

【要件】150文字以内、共感を呼ぶ親しみやすいトーン、ハッシュタグ3個含む

【制約】誇大表現禁止、薬事法遵守技術文書作成 対象読者の技術レベルを明示することで、専門用語の使用レベルが適切に調整される。「非技術系経営層向け」と「開発担当者向け」では、同じ内容でも出力が大きく変わる。

カスタマーサポート 顧客の状況(初回利用者/リピーター/苦情)を設定することで、適切な共感レベルと解決策の提示スタイルが得られる。以下のような制約追加が品質を大幅に向上させる。

【制約】責任回避の表現禁止・法的問題に言及しない・解決策を必ず含めるプロンプトの評価と改善サイクル

プロンプトエンジニアリングは一度で完成しない。関連性(求める回答との一致度)・正確性・完全性・使いやすさ・一貫性の5軸で評価し、改善を繰り返すことで初めて実用レベルに達する。

複数のプロンプトバリエーションを作成してA/Bテストを行い、指示の順序・例の数・制約条件の表現を変えながら統計的に優れたパターンを特定する。効果的だったプロンプトはテンプレートとしてデータベース化し、組織内で共有・再利用する仕組みを作ると、組織全体のプロンプト品質が着実に上がる。

大規模言語モデルの課題と対策

ハルシネーション(幻覚)問題への対処法

ハルシネーションとは、LLMが事実に基づかない情報を確信を持って生成してしまう現象だ。存在しない論文の著者名・実際には開催されていないイベントの詳細・根拠のない数値などを、もっともらしい文体で出力することがある。

発生しやすいのは、具体的な数値・固有名詞・最新情報・専門的な技術情報だ。LLMの動作原理が「もっともらしい次の単語を予測すること」にあるため、事実の正確性より文章の自然さが優先される場面で起きる。

対策は技術的なものと運用的なものの両輪で実施する。技術面では、信頼できる外部データソースから情報を取得してから回答を生成するRAG(Retrieval-Augmented Generation)システムの導入が効果的だ。同じ質問を複数のLLMで処理して回答の一致度を確認する手法も信頼性向上に使われる。

運用面では、「重要な意思決定に使う情報は必ず人間が確認する」というワークフローを徹底することが最も確実な対策だ。定期的な精度監査でハルシネーションが発生しやすいパターンを特定し、該当する質問には特別な検証プロセスを設ける。

バイアスと公平性確保のアプローチ

LLMは学習データに含まれる社会的バイアスを引き継ぐ。性別・人種・年齢・地域に関する偏見的な表現や固定観念が出力に反映されることがあり、採用選考・与信判断・顧客対応への活用では法的リスクと社会的信頼性への影響が直接発生する。

バイアスの検出には、対比テストが基本的な手法だ。「男性の営業担当者について説明して」と「女性の営業担当者について説明して」のように、属性のみを変えた同様の質問を複数作成し、回答の差異を分析する。

公平性向上には、プロンプト設計での対応が即効性がある。「性別・人種・年齢に関わらず公平に評価して」という明示的な指示を含めることで、偏見のない回答を促すことができる。モデルの学習データ自体の多様性確保は開発者側の課題だが、プロンプト設計で補える部分も多い。

著作権・倫理的考慮事項への対応

LLMが既存の著作物に酷似したコンテンツを生成するリスクがある。特に文学的な文章スタイル・楽曲・映画脚本に近いコンテンツを商用利用する際は、独自性チェックツールによる確認と必要に応じた法的レビューが推奨される。

組織内で利用する際は、使ってよい用途・使ってはいけない用途・確認が必要な用途を明確にした倫理ガイドラインを策定する。「AIが提案・人間が最終判断」という原則を明文化し、特に人の評価・判断に関わる用途ではAI依存を防ぐ運用ルールが不可欠だ。

情報の正確性検証とファクトチェック

重要な情報の正確性を確保するには、情報の種類に応じた検証レベルを設定することが実践的だ。

数値・日付・固有名詞などの事実情報は高精度な検証が必要で、複数の信頼できるソースとのクロスチェックが基本となる。意見・分析・予測については「不確実性を明示した上で参考情報として使う」という姿勢が適切だ。

自動化できる検証項目(信頼できるデータベースとの照合・数値の計算確認・引用元の存在確認)はツール化して効率化する一方、最終的な重要情報の確認は人間が行う体制を維持する。情報源の明示・検証プロセスの開示・更新日時の記録という透明性の確保が、利用者との長期的な信頼関係につながる。

未来展望と技術トレンド

AGI(汎用人工知能)への発展可能性

現在のLLMは特定分野では人間を上回る性能を示すが、真の「理解」に基づく知能ではなく統計的なパターン認識だという本質的な限界がある。常識的推論・因果関係の理解・長期記憶の活用・物理世界との相互作用など、人間の知能の多面性をまだ再現できていない。

AGI実現に向けた技術的アプローチは複数並行して進んでいる。モデルサイズのさらなる拡大、モデル効率の改善、テキスト・画像・音声・センサーデータを統合するマルチモーダル処理の強化、自律的な推論・計画能力の開発などだ。

研究者の間でもAGI実現時期の見方は大きく分かれており、楽観的な見方では2030年代前半、保守的な見方では2050年以降とする声もある。予測の幅が大きいこと自体が、技術的不確実性の高さを示している。

マルチモーダルAIの進化方向

現在のAI技術が向かっているのは、テキスト・画像・音声・動画を横断して処理するマルチモーダルAIへの統合だ。GoogleのGeminiやOpenAIのGPT-4oはすでにこの方向で進化しており、各モダリティを別々に処理するのではなく、最初から複数の感覚を持つAIとして設計されている。

次世代のマルチモーダルAIは、異なるモダリティ間の関係をより深く理解し、動画コンテンツの高度な分析やリアルタイム状況認識にも対応できるようになると見られる。ロボティクスとの統合により、物理世界での自律的な行動が可能なAIエージェントへの発展も研究が進んでいる。

社会インフラとしてのLLM活用

LLMは個別アプリケーションを超えて、社会の基盤インフラとしての役割を担いつつある。

行政分野では、24時間対応の行政相談窓口や多言語での情報提供、複雑な手続きの自動化支援への活用が進んでいる。デジタル庁が推進するガバメントAI「源内」は、2025年度中に全府省庁約18万人の政府職員を対象とした大規模実証が予定されており、国産LLMの実用化を政府主導で推進する取り組みだ。

教育分野では、学習者の理解度や学習スタイルを分析して最適な教材・指導方法を提案するパーソナライズ教育へのLLM活用が進んでいる。医療分野では、診療記録の整理・医学文献の検索支援・患者向け説明資料生成など、医師の業務負担を軽減する用途で普及が加速している。

2025年以降の技術・社会的影響予測

技術面では、モデルの効率化が大きなトレンドになっている。同等の性能をより少ない計算資源で実現する手法の開発が進み、スマートフォンやエッジデバイスで動く高性能LLMの実用化が視野に入っている。

社会的影響として、知識労働の構造的変化が加速する。文章作成・情報整理・コーディングなど、従来は高度な専門性とされた業務の多くがLLMで代替可能になる一方、AIの管理・評価・改善を担う役割と、AIが苦手な創造的・対人的業務の重要性が増す。

LLM技術のオープンソース化と軽量化により、大企業だけでなく中小企業や個人でも高度なAI技術を活用できる環境が整いつつある。AI技術格差の拡大リスクと、悪用防止のためのガバナンス整備が、社会全体の課題として重みを増している。

まとめ

ChatGPTとLLMの関係、技術的な仕組み、他社AIとの比較、日本語対応LLMの現状、ビジネス活用の実践手順まで解説してきた。最後に、読んだ内容を実際のアクションに結びつけるための3ステップを示す。

ステップ1:自社の「LLM適用候補業務」を3つリストアップする 定型文書の起草・問い合わせ対応の初期分類・社内ナレッジ検索など、繰り返し発生する文章業務から始めるのが効果的だ。まずは1業務に絞ってパイロット導入し、実際の効果と課題を確認する。

ステップ2:データセキュリティ要件を先に整理する どの情報をどのLLMサービスに入力してよいかを社内ガイドラインとして定める。この工夫を後回しにすると、機密情報の誤入力や情報漏洩リスクが発生する。国産LLMのオンプレミス活用が必要かどうかもこの段階で判断できる。

ステップ3:プロンプトを改善し続ける仕組みをつくる 初回のプロンプトが最善であることはほぼない。効果的だったプロンプトを蓄積・共有するテンプレートライブラリを整備し、組織全体の活用レベルを継続的に上げる仕組みを作る。

LLMの活用水準は、技術の理解度よりも「試行と改善を続けるかどうか」で決まる。まず動かしてみることから始めてほしい。

debono では、中小企業・成長企業向けのLLM・生成AI導入支援を行っています。「何から手をつければいいかわからない」という段階からご相談いただけます。

※本記事にはAIが活用されています。編集者が確認・編集し、可能な限り正確で最新の情報を提供するよう努めておりますが、AIの特性上、情報の完全性、正確性、最新性、有用性等について保証するものではありません。本記事の内容に基づいて行動を取る場合は、読者ご自身の責任で行っていただくようお願いいたします。本記事の内容に関するご質問、ご意見、または訂正すべき点がございましたら、お手数ですがお問い合わせいただけますと幸いです。