LLMとは?機械学習との違いを徹底解説

LLM(大規模言語モデル)は自然言語処理に特化した汎用AIで、従来の機械学習とはデータ処理方法・出力形式・適用領域が根本的に異なります。技術選択では、創造性と柔軟性が必要な業務にはLLM、高精度な数値予測には機械学習が適しており、初期投資と運用コストの構造も大きく違うため総合的な評価が重要です。最も効果的なのは両技術を組み合わせたハイブリッドアプローチで、各技術の強みを活かしながら、用途・コスト・組織能力を考慮した戦略的な技術選択が競争優位の鍵となります。

ChatGPTが登場して以降、「うちもAIを導入したい」という経営判断は珍しくなくなった。ところが、いざ検討を進めると「LLMと機械学習はどう違うのか」「どちらを選べばいいのか」という疑問に突き当たる担当者が多い。

両者は同じ「AI」というラベルで語られるが、技術の設計思想も、得意なことも、かかるコストも根本的に異なる。この記事では、その違いを整理したうえで、業務・予算・組織の条件に応じた技術選択の判断基準を示す。

LLM(大規模言語モデル)の基本知識

LLMとは何か

LLM(Large Language Model)は、インターネット上の膨大なテキストを学習した大規模な言語AIだ。数千億から数兆個のパラメータを持つニューラルネットワークが、書籍・論文・ウェブページなどから言語の構造とパターンを学習し、文脈を踏まえた自然な文章を生成する。

最大の特徴は汎用性にある。翻訳・要約・プログラミング支援・文書作成といった、従来なら個別のシステムが必要だった多様なタスクを、単一のモデルで処理できる。この汎用性が、企業や研究機関での導入を急速に後押ししている。

従来の言語モデルとの違い

以前の言語モデルは小規模なデータと限られたパラメータで構築されていたため、生成する文章の精度や自然さに限界があった。状況を変えたのがTransformerアーキテクチャの採用だ。文章内の単語間の関係を自己注意機構(Self-Attention)で捉えることで、文脈理解の精度が飛躍的に上がった。

また、以前は特定タスクごとに個別学習が必要だったが、LLMは事前学習によって幅広いタスクへの汎用的な対応能力を獲得した。少量の追加学習で新しいタスクに適応する「転移学習」の効果も大幅に向上している。

LLMが注目される背景

2022年11月にChatGPTがリリースされ、公開から5日間で100万ユーザーを突破したことは広く知られている。それ以来、企業でのLLM活用は文書作成・カスタマーサポート・データ分析レポートの自動生成など、知的作業の支援という形で急拡大した。

市場規模も顕著な伸びを示している。調査会社TechNavioの予測では、LLM市場は2024〜2029年の5年間で約203億ドル規模の成長が見込まれ、CAGRは34.7%に達するとされる(出典:TechNavio「大規模言語モデルの世界市場 2025〜2029年」)。国内でも富士キメラ総研の調査によれば、LLM市場は2028年度に2023年度比15.3倍の1,840億円に拡大すると予測されている。

代表的なLLMサービス

現在、主要なLLMサービスとして以下が挙げられる。

| 提供元 | サービス名 | 特徴 |

|---|---|---|

| OpenAI | GPT-4o / GPT-4.1 | 幅広いタスクに対応。ChatGPTとして一般にも普及 |

| Gemini | 検索エンジンとの連携により最新情報へのアクセスが強み | |

| Anthropic | Claude | 長文処理と安全性設計に注力。企業導入で採用が増加 |

| Meta | LLaMA | オープンソース。自社環境へのカスタマイズが可能 |

用途や要件によって最適なモデルは異なる。APIコストの比較については後述のコスト比較セクションを参照してほしい。

機械学習の基礎と種類

機械学習の基本概念

機械学習(Machine Learning)は、データから自動的にパターンを学習し、明示的なプログラムなしに予測や判断を行う技術だ。AIの一分野であり、統計学とデータマイニングの手法を活用してモデルを構築する。

基本的な仕組みは、大量データを入力として統計的なパターンを抽出することにある。手書き数字の認識を例にとれば、数千枚の画像を学習データとして与え、それぞれの数字の特徴を学習させる。完成したモデルは、初見の手書き画像を見てそれが何の数字かを予測できる。データ量が増えるほど精度が上がり、人間には発見しにくい複雑なパターンも見つけ出せる。

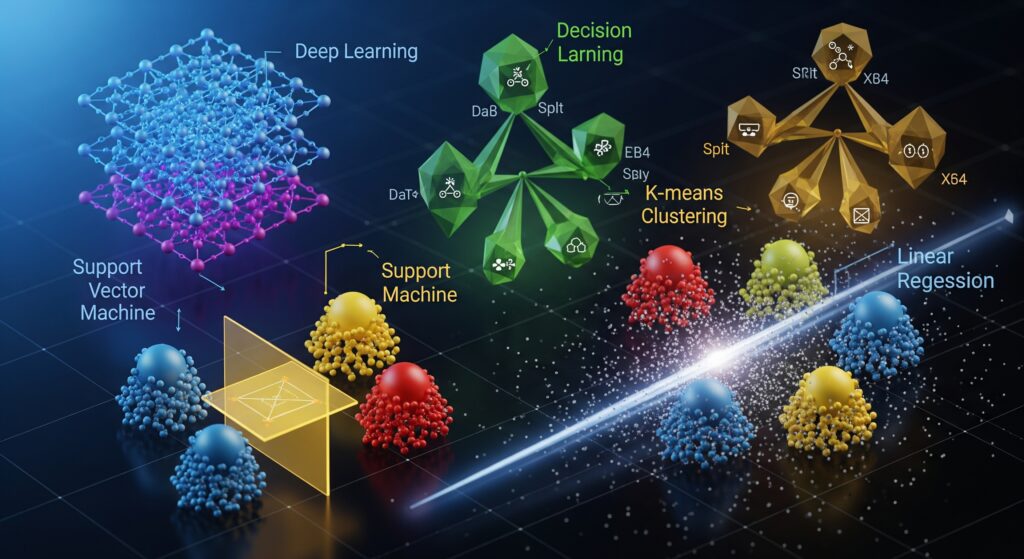

学習の3つの種類

教師あり学習は、正解ラベルが付いた訓練データを使う手法だ。スパムメール判定(分類問題)や売上予測(回帰問題)が代表例で、企業では購買予測・不良品検出などで広く活用されている。

教師なし学習は、正解データがない状態でデータの構造を発見する。顧客セグメンテーションや異常検知がこれにあたる。強化学習は、環境との試行錯誤を通じて最適な行動を学習する手法で、ゲームAIやロボット制御で成果を上げている。

機械学習の活用領域

機械学習はすでに多くの業界に浸透している。金融では不正取引の検出に使われ、従来の統計手法では見逃していた詐欺パターンの検知精度が大幅に向上した。医療ではCTやMRI画像からの病変自動検出が実用化され、診断支援に貢献している。製造業では、センサーデータから機械の故障を事前に予知し、突発的な設備停止を減らす予知保全システムが広がっている。

従来の機械学習手法の特徴

従来の機械学習では、生データから機械学習モデルが扱いやすい数値特徴を人間が設計する「特徴量エンジニアリング」が重要な工程だった。テキストならTF-IDF、画像なら色ヒストグラムやエッジ検出といった手法がドメイン知識と組み合わせて使われていた。

代表的な手法は線形回帰・決定木・ランダムフォレスト・SVM(サポートベクターマシン)などで、いずれも比較的軽量で解釈しやすい。少量データでも良好な精度を出せるうえ、「なぜその予測になったか」を説明できる透明性が、金融や医療といった説明責任が求められる分野で現在も重宝されている。

LLMと機械学習の本質的な違い

二つの技術を一覧で比較すると、違いが鮮明になる。

| 比較項目 | LLM | 従来の機械学習 |

|---|---|---|

| 主な入力データ | テキスト(自然言語) | 数値・構造化データ・画像など |

| 特徴量設計 | 自動(モデルが内部で学習) | 人間が設計(特徴量エンジニアリング) |

| 学習方式 | 事前学習+微調整(汎用→特化) | タスクごとに個別学習 |

| 主な出力 | 自然言語テキスト | 数値・分類ラベル・確率 |

| 汎用性 | 高い(単一モデルで多タスク対応) | 低い(タスクごとに専用モデルが必要) |

| 精度の特性 | 確率的・生成ごとに変化しうる | 安定・再現性が高い |

| 説明可能性 | 低い(ブラックボックス) | 高い(決定木など解釈しやすい手法あり) |

| 最小データ量 | 事前学習済みのため少量でも適用可 | タスクに応じた学習データが必要 |

| インフラ要件 | GPU必須(API利用なら不要) | CPUベースでも動作可能 |

データ処理アプローチの違い

従来の機械学習では、人間が手動で特徴量を設計し、データを数値化してモデルに入力していた。テキスト分析なら単語の出現頻度、画像分析なら色や形状の特徴を数値化する前処理が前提だった。

LLMは生のテキストデータを直接処理する。内部でトークン化と高次元ベクトル変換を自動で行い、文脈を考慮した表現を学習する。この仕組みにより、人間が設計した特徴量を超える表現力を持つ。

必要なデータ量も異なる。従来の機械学習は数百〜数万件のデータで有効なモデルを作れる。LLMは事前学習に数十億〜数兆トークンを必要とするが、この大規模学習によって汎用的な言語理解能力を獲得し、追加データが少量でも新しいタスクに適応できる。

学習方式の違い

従来の機械学習はタスク特化型だ。売上予測・不良品検出・スパム判定など、問題ごとに最適化されたアルゴリズムとデータセットでモデルを構築する。各タスクに異なる手法と特徴量設計が必要で、ドメイン専門家の知識が重要な役割を果たす。

LLMは事前学習(Pre-training)と微調整(Fine-tuning)の二段階で学習する。まず膨大なテキストで言語の汎用パターンを習得し、その後に特定タスクへ適応させる。この構造が、翻訳・要約・質問応答などを単一モデルで処理できる理由だ。

アーキテクチャも対照的だ。従来の機械学習では問題に応じて線形回帰・決定木・SVMなどから選ぶ。LLMはTransformerアーキテクチャが基本で、Self-Attentionにより文章内の全単語間の関係を並列処理し、長距離の文脈依存関係を捉える。

出力の特性

従来の機械学習の出力は主に数値予測か分類結果だ。回帰では連続値、分類では確率やクラスラベルを返す。MSE・Accuracy・F1スコアなどの統計的指標で定量評価でき、結果の解釈も比較的容易だ。

LLMの出力は自然言語テキストで、自由度が高い分だけ評価が複雑になる。生成された文章の品質・正確さ・適切さを定量的に測るのは難しく、人間による主観的評価が必要になる場面も多い。また、同じ入力に対して毎回同じ出力が返るとは限らない確率的な性質を持つ。これは創造性や多様性の面では利点だが、一貫性や再現性が求められる業務では注意が必要だ。

汎用性と専門性のトレードオフ

LLMの強みは「多くのことができる」汎用性にある。単一モデルで文章生成・翻訳・要約・QA・コード生成をこなし、新タスクへの適応も早い。

従来の機械学習は「特定のことを高精度でやる」専門性に優れる。特定工程に特化した画像認識モデルが人間を上回る検出精度を出せるのは、その専門性ゆえだ。医療診断支援・金融リスク評価のように高精度が法的・倫理的に要求される領域では、今なお従来手法が主役だ。

実装・運用における違い

必要なスキルと学習コスト

従来の機械学習を実務で使うには、統計学の基礎・Python/R・データ前処理・特徴量エンジニアリング・モデル評価と幅広いスキルが必要で、実務レベルまでの習得には通常1〜2年かかる。

LLMの活用では、プロンプトエンジニアリングが中心的スキルになる。適切な指示文で望ましい出力を引き出す技術で、統計学や数学の深い知識は必須ではない。API経由での実用的な活用であれば数週間〜数ヶ月で基本を習得できる。

ただし、LLMの本格的な開発やファインチューニングを行う場合は話が変わる。深層学習・Transformerアーキテクチャ・大規模分散学習の専門知識が必要になり、インフラ面でも高度な知識が求められる。社内で何をどこまでやるかを先に整理しておくことが、学習コストの見積もりに直結する。

開発期間とリソース

従来の機械学習プロジェクトは、問題定義からデータ収集・前処理・モデル開発・評価・本番準備まで、3ヶ月〜1年程度を要するのが一般的だ。データの品質整備と特徴量設計に時間を取られるケースが多い。データサイエンティスト・エンジニア・ドメイン専門家の三者が揃う体制が求められる。

LLMでは、OpenAI APIやAnthropic Claude APIなどの既存サービスを使うなら、数日〜数週間で基本的なシステムを動かすことができる。プロンプト設計と既存システムとの連携が主な作業で、少人数のエンジニアでも実装できる。自社でLLMをゼロから開発する場合は別で、数億〜数十億円規模の投資と専門チームが必要になる。

インフラとハードウェア

従来の機械学習はCPUベースのサーバーで動作するケースが多く、メモリ要件も数GB〜数十GB程度で収まることが多い。クラウドの小規模インスタンスでも十分な性能を発揮できる。

LLMを自社ホスティングする場合、NVIDIA H100などの高性能GPUが複数台必要になり、初期投資は数百万〜数千万円規模になる。これに大容量メモリと高速ストレージが加わる。

APIサービスを利用するなら自社でのハードウェア投資は不要で、使用量に応じた従量課金で始められる。PoC段階や中小企業での導入にはAPIサービスが現実的だ。ネットワーク帯域と可用性の確保が主な技術要件となる。

メンテナンスと改善

従来の機械学習では、データドリフト(データ分布の経時変化)への対応が継続的な課題になる。新データの追加・特徴量の見直し・ハイパーパラメータ調整・モデル再学習を定期的に行う必要がある。

LLMのメンテナンスは、プロンプトの継続的な最適化とファインチューニングが中心だ。APIサービスを使っていれば、プロバイダー側のモデル更新で性能向上の恩恵を自動で受けられる場合もある。

コスト管理の面ではLLMの方が変動が大きい。従来の機械学習は本番稼働後のコストが比較的安定しているが、LLMのAPIサービスは利用量に比例してコストが増える。月間処理量の監視と、同じ結果をより少ないトークンで実現するプロンプト効率化が、運用改善の重要テーマになる。

用途別の選択指針

LLMが適している場面

自然言語処理が中心のタスクではLLMが圧倒的に有利だ。カスタマーサポートの自動応答・コンテンツ制作・文書要約・多言語翻訳では、従来の機械学習では実現しにくかった品質が出る。文脈理解と創造的な文章生成が必要な場面では、LLMの選択が基本になる。

プロトタイプ開発や概念実証(PoC)にも向いている。複雑なルールベースシステムや専用AIモデルの構築に数ヶ月かかるようなタスクも、適切なプロンプト設計で数日〜数週間でプロトタイプを動かせる。初期検証のスピードが格段に速い。

複数の業務を一つのシステムで処理したい場合も、LLMの強みが生きる。メール対応・資料作成・分析レポート生成を単一モデルで賄えれば、複数システムの統合コストと運用負荷が大幅に下がる。

従来の機械学習が有効な場面

高精度な数値予測が必要な領域では、従来の機械学習が依然として主役だ。株価予測・需要予測・リスク評価など、厳密な数値計算が求められる金融・経営分析では、確率的なテキスト生成に特化したLLMよりも統計的手法に分がある。

リアルタイム性が求められる用途でも従来手法が適している。製造ラインの品質管理・ネットワーク侵入検知・衝突回避システムなど、ミリ秒単位の応答が必要な場面では、LLMの処理遅延は実用上の障壁になる。

説明可能性が求められる業種でも、従来の機械学習が選ばれる。融資審査・保険査定・医療診断支援では、「なぜその判断に至ったか」を根拠付きで説明する義務が発生する。決定木やロジスティック回帰は判断プロセスが可視化しやすく、規制環境が厳しい業界では不可欠な特性だ。

業種・用途別の選択マトリクス

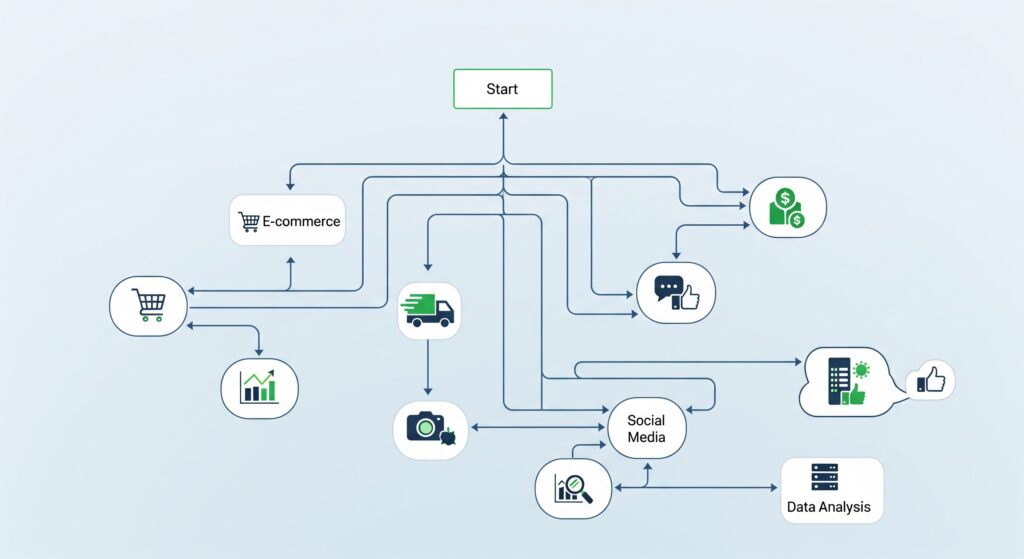

| 業種 / 用途 | LLM推奨 | 機械学習推奨 | ハイブリッド推奨 |

|---|---|---|---|

| 小売・EC | 商品説明生成、チャットサポート | 購買予測、レコメンド | パーソナライズメール(予測→文章生成) |

| 金融 | 契約書レビュー補助、レポート作成 | 不正検知、信用スコアリング | 異常検知+説明文自動生成 |

| 製造 | 技術文書の翻訳・要約 | 予知保全、不良品検出 | 検査結果の自然言語レポート化 |

| 医療 | カルテ要約、患者向け説明文作成 | 画像診断支援、予後予測 | 診断支援+患者向け説明生成 |

| HR・採用 | 求人票作成、面接フィードバック生成 | 離職予測、人材マッチング | スクリーニング+フィードバック文生成 |

組み合わせて活用するアプローチ

最も効果的なのは両技術を組み合わせたハイブリッドアーキテクチャだ。顧客データの購買予測・セグメンテーションを機械学習で行い、その結果をLLMに渡してパーソナライズされたマーケティング文章を自動生成する、という流れが典型例として挙げられる。

数値データから重要パターンを機械学習で抽出し、その結果をLLMが自然言語で要約・報告するシステムを作れば、データサイエンティスト以外でも読めるレポートが自動で出来上がる。

設計の基本は「構造化データの分析は機械学習、テキスト処理はLLM、全体の統合はAPIオーケストレーション」だ。それぞれの強みを分業させることで、単独では出せない精度と柔軟性が両立する。

技術選択の判断基準

判断の出発点は要求精度だ。安全性に直結するシステムで99%以上の精度が必要なら機械学習を選ぶ。業務効率化目的で90%程度の精度で十分なら、LLMの開発スピードと柔軟性の方が勝る。

開発期間と予算も重要な変数だ。短期実装・初期投資を抑えたいならLLMのAPIサービス活用が現実的。長期的な運用コスト削減と独自性を重視するなら、専用の機械学習システムへの投資が効いてくる。

データの種類と量も判断に影響する。大量のラベル付きデータが揃っているなら機械学習が有効。データが少ない、またはラベル付けが困難なら、事前学習済みLLMの活用の方が現実的だ。機密性の高いデータを扱う場合は、オンプレミス運用が可能な機械学習が選ばれることが多い。

コストと効果の比較分析

初期投資と運用コスト

従来の機械学習プロジェクトでは、人件費が初期投資の大半を占める。データサイエンティスト・機械学習エンジニア・ドメイン専門家を確保し、3ヶ月〜1年の開発期間をカバーすると、初期投資は概ね500万〜3,000万円の規模になる。

LLMではAPIサービスを使うことで初期投資を大きく抑えられる。現在のAPIコストはモデルにより幅があるが、たとえばGPT-4oは入力100万トークンあたり2.5ドル、出力100万トークンあたり10ドルが目安だ(出典:OpenAI公式価格ページ。価格は随時変更される)。プロトタイプ段階なら月額数万円から始められ、開発人員も少数で済む。初期投資は50万〜500万円程度に抑えられるケースが多い。

ただし運用コストの構造は異なる。機械学習はシステム稼働後のコストが比較的安定しており、サーバー維持費と保守人件費が主な変動要因だ。LLMのAPIサービスは利用量に比例してコストが上がる。月間100万リクエストを超えるようなスケールでは、月額数十万〜数百万円に達することもあるため、利用規模の試算は事前に行っておく必要がある。

ROI実現の期間

機械学習プロジェクトは投資回収まで通常12〜24ヶ月を要する。開発期間・本番稼働後の調整・効果測定期間を合算するとこの程度になる。精度改善とビジネスプロセスへの定着に時間がかかることが多い。

LLMを使ったソリューションはROI実現を早めやすい。開発期間が短く初期投資も少ないため、3〜9ヶ月で投資回収した事例が出ている。業務効率化や人件費削減の効果が数値化しやすい用途では特にそうだ。

ただしLLMの効果測定は複雑な面もある。顧客満足度の向上やクリエイティブな業務の品質改善は定量化しにくい。コスト削減の直接効果だけでなく、間接的な効果も含めた総合評価の設計が必要だ。

リスクと対策

機械学習のリスクは主にデータ品質・モデル性能不足・運用環境での精度劣化だ。十分な検証期間の確保、段階的な本番移行、継続的な性能監視が基本的な対策になる。

LLMで注意すべきリスクは出力の不確実性とコントロールの難しさだ。意図しない内容の生成・機密情報の混入・偏りのある回答が発生しうる。プロンプトの厳密な設計・出力内容の自動チェック・最終確認の人間介在というプロセスが必要になる。

両技術に共通するのは技術陳腐化のリスクだ。AI分野の変化が速く、今年投資したシステムが数年で時代遅れになる可能性がある。アーキテクチャの柔軟性を確保し、ベンダーロックインを避ける設計が長期的には重要だ。

導入効果の測定

大手金融機関での機械学習による不正検知システムの導入では、検知率85%から95%への向上、誤検知率の5%から2%への低下、月間調査工数の500時間から200時間への削減といった定量的な成果が報告されている(公開情報ベース)。

LLM活用の事例として、カスタマーサポート自動化がある。チャットボットの応答品質向上により顧客満足度が改善し、サポート担当者の対応工数を削減できた事例は複数の企業で報告されている。

効果測定では、コスト削減・処理時間短縮・精度向上という定量指標と、顧客満足度・従業員満足度・ブランド価値という定性指標の両方を設定することが重要だ。LLMの場合、創造性や柔軟性の向上は数値化しにくいため、測定設計を導入前に固めておくことが成功の条件になる。

企業がAI導入を始めるためのステップ

Step 1:課題と目的の言語化

AI導入で失敗する最大の原因は「技術ありき」で進めてしまうことだ。まず「どの業務の何を改善したいか」を言語化する。「問い合わせ対応の工数を月100時間削減したい」「製品不良の見逃しをゼロにしたい」など、数値目標に落とせる粒度まで落とし込む。目的が曖昧なまま技術選定に入ると、PoCが終わっても本番移行できないまま終わる。

Step 2:PoC(概念実証)の設計

目的が固まったら、小規模なPoCで技術の有効性を検証する。LLMなら既存のAPIサービスで2〜4週間、機械学習なら手持ちデータでのプロトタイプ構築から始めるとよい。PoCの成功基準(精度・処理速度・コスト)を事前に設定しておくことが、本番移行判断を客観的に行うための条件になる。

Step 3:ベンダー・パートナーの選定

自社だけで構築するか、外部の支援を活用するかの判断が必要だ。内製のメリットはノウハウの蓄積とコスト管理にある。外部支援のメリットはスピードと専門性だ。システムインテグレーターやAI専門のコンサルティング会社を活用する場合は、過去の導入実績・業界知識・保守体制を比較基準にする。

クラウド主要3社(AWS・Google Cloud・Microsoft Azure)はいずれもLLM・機械学習両方のマネージドサービスと技術サポートを提供しており、自社インフラの整備状況と合わせて検討するとよい。

Step 4:社内体制と人材の整備

技術導入と並行して、社内の推進体制を作る。LLMの活用ならプロンプトエンジニアリングを担える人材、機械学習ならデータサイエンティストかその外部調達手段の確保が必要だ。AI活用の恩恵を受ける現場部門との連携体制も、早い段階で設計しておく。

AIツールの利用ガイドライン(情報セキュリティ・利用範囲・出力確認プロセスなど)の整備も、社内展開の前に済ませておく必要がある。

Step 5:段階的な本番移行と効果測定

PoCの検証後、パイロット部門での限定運用から始める。効果測定指標を毎月追跡し、改善点を蓄積しながら展開範囲を広げていく。AI導入プロジェクトは一度完成したら終わりではなく、継続的な改善が前提だ。技術トレンドの変化も速いため、半年〜1年単位で技術構成の見直しを行う仕組みを最初から組み込んでおくとよい。

よくある質問(FAQ)

Q1. LLMは機械学習の一種ですか?

LLMは機械学習の一種であるディープラーニング(深層学習)に分類される。機械学習を大きな括りとするなら、LLMはその中の特定の技術領域にあたる。ただし実務上の設計思想・必要スキル・コスト構造はまったく異なるため、「LLMか機械学習か」という問いかけは有効だ。

Q2. 小規模な企業でもLLMは使えますか?

APIサービスを利用すれば、数万円の月額コストから始められる。自社でモデルをホスティングするわけではないため、GPU投資も不要だ。プロンプトエンジニアリングさえできるエンジニアがいれば、数週間で実用的なシステムを動かせる。中小企業への導入ハードルは、この2〜3年で大幅に下がっている。

Q3. 社内の機密データをLLMに入力しても大丈夫ですか?

APIサービスに機密データを送信する場合、利用規約とデータ保持ポリシーの確認が必須だ。機密性が高い場合は、オンプレミスへのLLM構築か、プライベートクラウドでのAPIサービス利用(Azure OpenAI ServiceなどのEnterpriseプランなど)を選択する。データ処理範囲を限定するアーキテクチャ設計も有効な対策だ。

Q4. LLMの出力は信用できますか?

LLMは「もっともらしい文章」を生成するモデルであり、事実と異なる内容を出力する「ハルシネーション(幻覚)」が起きる。業務での利用においては、重要な情報の最終確認を人間が行うプロセスを設計に組み込むことが前提になる。高い正確性が求められる用途ではRAG(検索拡張生成)の組み合わせが有効だ。

Q5. LLMと機械学習、どちらを先に検討すべきですか?

業務課題の性質で決まる。テキストを扱う業務(文書処理・サポート・報告書作成)ならLLMから始めると早い。数値データを使った予測・分類・異常検知が課題なら機械学習を先に検討する。両方が絡む場合は、まずLLMでPoCを回してスピードを稼ぎ、精度が必要な部分に機械学習を組み込む順番が多い。

debono では、LLM・機械学習の技術選定から実装支援まで対応しています。「自社に合った技術がわからない」「PoCをどう設計すればいいか」といったご相談は、以下からお気軽にどうぞ。

※本記事にはAIが活用されています。編集者が確認・編集し、可能な限り正確で最新の情報を提供するよう努めておりますが、AIの特性上、情報の完全性、正確性、最新性、有用性等について保証するものではありません。本記事の内容に基づいて行動を取る場合は、読者ご自身の責任で行っていただくようお願いいたします。本記事の内容に関するご質問、ご意見、または訂正すべき点がございましたら、お手数ですがお問い合わせいただけますと幸いです。